Künstliche allgemeine Intelligenz (AGI) bezeichnet KI-Systeme, die in der Lage sind, Aufgaben in verschiedenen Bereichen mit einer menschenähnlichen Anpassungsfähigkeit auszuführen. Im Gegensatz zu Science-Fiction-Darstellungen von sofortiger Superintelligenz oder empfindungsfähigen Robotern erfolgt der Fortschritt in Richtung AGI schrittweise und ist eher durch technische Meilensteine als durch dramatische Sprünge gekennzeichnet. Hier ist, was Sie wissen müssen:

- Der Fortschritt ist schrittweise: Ende 2025 erreichte GPT-5 57 % bei AGI-bezogenen Benchmarks und zeigte damit Verbesserungen beim logischen Denken und bei der Problemlösung, war jedoch noch weit von der menschlichen Kognition entfernt.

- Es gibt weiterhin Grenzen: KI hat Schwierigkeiten mit dem Langzeitgedächtnis, physikalischem Denken und der Anpassung an neue Aufgaben ohne erneutes Training.

- Wichtige Benchmarks: Herausforderungen wie das Zubereiten von Kaffee (der Kaffeetest) oder das Zusammenbauen von Möbeln (der Ikea-Test) verdeutlichen die Lücken in der allgemeinen Problemlösungsfähigkeit der KI.

- Technische Herausforderungen: Rechenleistung, Energiebedarf und „katastrophales Vergessen“ behindern die Entwicklung, während geopolitische Spannungen den Zugang zu Ressourcen wie fortschrittlichen Chips erschweren.

- Sicherheitsbedenken: Missbrauchsrisiken, Ausrichtungsprobleme und ungleichmäßige Leistung unterstreichen die Notwendigkeit einer vorsichtigen Entwicklung.

- Zeitplan: Experten schätzen, dass AGI bis 2030 ein menschliches Leistungsniveau erreichen könnte, einige gehen jedoch davon aus, dass dies erst 2040 oder später der Fall sein wird.

Trotz des Hypes sind die heutigen KI-Systeme immer noch eher Werkzeuge als empfindungsfähige Wesen. Der Fortschritt schreitet stetig voran, und jeder Fortschritt bringt uns näher an praktische Anwendungen in Wissenschaft, Technik und darüber hinaus. Der Weg dorthin bleibt jedoch komplex und erfordert Zusammenarbeit, verantwortungsvolle Entwicklung und klare Ziele.

Die Realität der AGI, die jeder falsch versteht

sbb-itb-e314c3b

Was AGI ist: Kernfähigkeiten und Science-Fiction-Mythen

Künstliche allgemeine Intelligenz (AGI) bezieht sich auf Systeme, die die kognitive Flexibilität und die Fähigkeiten eines gebildeten Menschen bei einer Vielzahl von Aufgaben erreichen können. [1][3. Diese Definition konzentriert sich auf funktionale Fähigkeiten wie logisches Denken, gesunden Menschenverstand, Planung, selbstständiges Lernen, natürliche Kommunikation, Wahrnehmung der Welt und Speicherung von Informationen. Im Gegensatz zu schmaler KI, die sich durch hervorragende Leistungen bei bestimmten Aufgaben wie Schach oder Bilderkennung auszeichnet, würde AGI eine menschenähnliche Anpassungsfähigkeit zeigen und Fähigkeiten nahtlos zwischen nicht miteinander verbundenen Bereichen übertragen [7][3.

Aktuelle KI-Systeme weisen jedoch ein „uneinheitliches” kognitives Profil auf [1][3]. Sie mögen Menschen bei Aufgaben übertreffen, die umfangreiches Wissen oder mathematische Präzision erfordern, aber in grundlegenden Bereichen wie dem Langzeitgedächtnis oder dem Verständnis der physikalischen Welt versagen sie. Selbst fortschrittliche Modelle wie GPT-5 liefern beispielsweise in über 30 % der Fälle beim SimpleQA-Benchmark [3. Eine wesentliche Einschränkung besteht darin, dass heutige KI-Modelle nach dem Training „eingefroren“ sind und nicht in der Lage sind, aus neuen Erfahrungen zu lernen und sich anzupassen, ohne erneut trainiert zu werden [3.

„Künstliche allgemeine Intelligenz (AGI) ist die Fähigkeit eines intelligenten Agenten, jede intellektuelle Aufgabe zu verstehen oder zu erlernen, die Menschen oder andere Tiere bewältigen können.“ – Andrew Ng, Gründer, DeepLearning.AI [8]

Es ist wichtig, AGI von „Starker KI” zu unterscheiden. Während AGI darauf abzielt, funktionale Fähigkeiten auf menschlichem Niveau zu erreichen, impliziert Starke KI eine Maschine mit Empfindungs- oder Bewusstseinsfähigkeit. In der Technik liegt der Fokus weiterhin auf praktischem, zielorientiertem Verhalten und nicht auf der Nachahmung menschenähnlicher Bewusstseinsprozesse. [7][3].

Wichtige Benchmarks für AGI

Forscher entfernen sich von einem einfachen „AGI oder nicht”-Ansatz und wenden stattdessen ein mehrstufiges Rahmenwerk an, das auf Fähigkeiten und Allgemeingültigkeit basiert. [11][5]. Google DeepMind beispielsweise unterteilt die AGI-Entwicklung in fünf Stufen: Emerging (Stufe 1, wie ChatGPT), Competent (Stufe 2), Expert (Stufe 3), Virtuoso (Stufe 4) und Superhuman (Stufe 5) [4][7. Diese Stufen spiegeln den Fortschritt in Bereichen wie Schlussfolgerungen und Problemlösungen wider und zeigen gleichzeitig die noch bestehenden Lücken auf [1][3].

Um den Fortschritt der AGI zu messen, wird in praktischen Tests bewertet, wie gut Systeme reale Aufgaben bewältigen können:

- Der Kaffeetest: Kann die KI in ein Haus kommen und herausfinden, wie man Kaffee kocht? [7]

- Der Ikea-Test: Kann es Möbel aus Flachpackungen nur mit den mitgelieferten Teilen und Anleitungen zusammenbauen? [7]

- Der moderne Turing-Test: Kann er durch autonome Entscheidungsfindung 93.000 € in 930.000 € verwandeln? [7]

Diese Herausforderungen betonen Anpassungsfähigkeit und Problemlösungskompetenz in unvorhersehbaren Umgebungen und gehen über enge, aufgabenspezifische Benchmarks hinaus.

Jüngste Fortschritte unterstreichen diese Entwicklung. Das o3-Modell von OpenAI beispielsweise erreichte beim wissenschaftlichen Denk-Benchmark GPQA Diamond eine Leistung auf Doktoranden-Niveau und löste bis Ende 2024 25 % der hochkomplexen Probleme des Frontier Math-Benchmarks. [2]. Bei Softwareentwicklungsaufgaben, für die menschliche Entwickler in der Regel eine Stunde benötigen, verbesserte sich die KI-Leistung mit dem o3-Modell von fast 0 % im Jahr 2020 auf über 70 % [2. Diese Fortschritte spiegeln die Entwicklungen im Bereich des emergenten Denkens wider, bei dem Modelle mehrstufige Probleme lösen, anstatt lediglich Fakten abzurufen. Solche Fortschritte stellen einige der eher spekulativen Narrative rund um AGI infrage.

Häufige Science-Fiction-Mythen über AGI

Trotz messbarer Fortschritte wird die öffentliche Wahrnehmung von AGI oft von Mythen geprägt, die in Science-Fiction-Geschichten populär gemacht wurden. In diesen Geschichten wird AGI häufig mit menschenähnlichem Bewusstsein, Emotionen oder sogar einem angeborenen Drang nach Dominanz dargestellt. In Wirklichkeit ist AGI weit von diesen Darstellungen entfernt. Wie Henry Farrell erklärt, können große KI-Modelle „niemals so intelligent sein wie Menschen oder sogar Hummeln, da KI nicht kreativ sein kann. Sie kann nur Inhalte widerspiegeln, komprimieren oder sogar neu zusammenstellen, die bereits von Menschen geschaffen wurden“ [9]. Diese Unterscheidung zwischen Mustererkennung und echter Handlungsfähigkeit ist entscheidend.

Ein weit verbreiteter Mythos ist die Vorstellung von sofortiger Superintelligenz, bei der KI plötzlich allmächtig wird. Der Fortschritt in der KI erfolgte jedoch schrittweise und nicht sprunghaft. Andrew Ng unterstreicht dies mit folgender Perspektive: „Ich denke, wir haben im vergangenen Jahr einen Jahrestag voller aufregender Fortschritte auf einer Reise hinter uns, die vielleicht 50 oder 100 Jahre dauern wird.“ [8]. Die meisten Forscher sind sich einig, dass die aktuellen neuronalen Netzwerkarchitekturen für die Erreichung einer AGI unzureichend sind. 84 % der AAAI-Mitglieder geben dies ausdrücklich an, und 76 % bezweifeln, dass die Skalierung bestehender Methoden zu einer AGI führen wird [9.

Ein weiteres Missverständnis ist, dass AGI eine einheitliche „Superintelligenz” in allen Bereichen erreichen wird. Die Realität sieht jedoch weitaus uneinheitlicher aus. Gary Marcus erklärt: „Die Muster, die [Deep Learning] lernt, sind ironischerweise oberflächlich und nicht konzeptionell ... Man kann nicht mit einer Person umgehen, die ein Stoppschild trägt, wenn man nicht wirklich versteht, was ein Stoppschild überhaupt ist.” [10]. Dies verdeutlicht die Grenzen aktueller Systeme, denen oft ein tieferes, konzeptionelles Verständnis fehlt. Beispielsweise kann eine KI zwar hervorragend programmieren, hat aber Schwierigkeiten mit grundlegenden physikalischen Überlegungen oder Gedächtnisaufgaben [1.

Schließlich bleibt der Zeitplan für AGI weiterhin umstritten. Während einige Branchenführer davon ausgehen, dass AGI bis 2027–2030 verfügbar sein könnte, glauben die meisten Forscher, dass dies eher um 2040 der Fall sein wird [7][2]. Historische Behauptungen über bevorstehende Durchbrüche – wie beispielsweise im Zusammenhang mit IBM Watson im Jahr 2011 – erinnern daran, dass es bei der Entwicklung der KI immer wieder zu übertriebenen Versprechungen und enttäuschenden Ergebnissen kommt [8. Darüber hinaus werden viele aktuelle KI-Systeme als „Demoware” bezeichnet, die in kontrollierten Umgebungen gut funktionieren, aber in realen, unvorhersehbaren Szenarien versagen [9[10.

Aktuelle technische Fortschritte in der AGI-Forschung

Die jüngsten Fortschritte bringen KI-Systeme der Erreichung einer künstlichen allgemeinen Intelligenz (AGI) immer näher. Diese Entwicklungen konzentrieren sich auf die Verbesserung praktischer Fähigkeiten wie logisches Denken, autonome Problemlösung und wissenschaftliche Beiträge, anstatt sich auf spekulative Sprünge zu verlassen. Forscher entwerfen Architekturen, die Modelle in die Lage versetzen, komplexe Herausforderungen zu bewältigen, Werkzeuge selbstständig einzusetzen und bahnbrechende Entdeckungen zu unterstützen.

Algorithmus-Fortschritte treiben den Fortschritt voran

KI-Systeme entwickeln sich von der einfachen Mustererkennung hin zu einem eher überlegten Denken. Die o1-Modellreihe von OpenAI nutzt beispielsweise groß angelegtes Reinforcement Learning, um einen Gedankenkettenansatz zu verfolgen. Dadurch kann das Modell komplexe Probleme systematisch durcharbeiten, bevor es Antworten generiert:

„Die Modellreihe o1 wird mit groß angelegten Verstärkungslernverfahren trainiert, um mithilfe von Gedankenketten zu argumentieren.“ – OpenAI [16]

Ein weiterer bemerkenswerter Meilenstein wurde im Dezember 2025 mit der Veröffentlichung von INTELLECT-3 durch die Erstklassige Intelligenz Team. Dieses Mixture-of-Experts-Modell mit 106 Milliarden Parametern aktiviert während der Inferenz 12 Milliarden Parameter und liefert außergewöhnliche Leistungen in Mathematik und Codierung. Trainiert unter Verwendung der offenen prime-rl INTELLECT-3 nutzt ein Framework mit 512 H200-GPUs und demonstriert die Skalierbarkeit des verstärkenden Lernens in Multiprozessorsystemen. [12].

Auch die Fortschritte bei der Verallgemeinerung auf neue Aufgaben haben sich deutlich beschleunigt. Während des ARC-Prize-Wettbewerbs im Dezember 2024 verbesserte sich die Punktzahl des privaten ARC-AGI-Bewertungssatzes von 33 % auf 55,5 %. Dieser Sprung wurde durch Techniken wie Deep-Learning-gesteuerte Programmsynthese und Testzeit-Training erreicht, die es Modellen ermöglichen, sich an unbekannte Herausforderungen anzupassen:

„Die hochmoderne Punktzahl im privaten Bewertungssatz von ARC-AGI stieg von 33 % auf 55,5 %, angetrieben durch mehrere bahnbrechende AGI-Argumentationstechniken, darunter Deep-Learning-gesteuerte Programmsynthese und Testzeit-Training.“ – François Chollet, Entwickler von Keras, Google [14]

Forscher integrieren auch umfassendere agentenbasierte Frameworks in KI-Systeme. Durch die Kombination von Basismodellen mit Speicher, hierarchischen Planern, Weltmodellen und Werkzeugverwendungsfähigkeiten können diese Systeme den Kontext über Interaktionen hinweg aufrechterhalten, Ziele in kleinere Schritte unterteilen und Aufgaben autonom ausführen. Dies markiert eine Verlagerung hin zur Schaffung einer KI, die als unabhängiger Agent fungieren kann [13].

Diese algorithmischen Fortschritte ebnen den Weg für wirkungsvolle Anwendungen in der Praxis.

Praktische Anwendungen von AGI-Vorläufern

Die Fortschritte bei den Algorithmen zeigen bereits in der Praxis Wirkung. So dokumentierte beispielsweise im November 2025 ein Forschungsteam unter der Leitung von Sébastien Bubeck und Timothy Gowers, dass GPT-5 vier zuvor ungelöste mathematische Probleme erfolgreich gelöst hatte. Dies zeigte die Fähigkeit von GPT-5, bedeutende Erkenntnisse für die laufende Forschung in Bereichen wie Physik, Biologie und Materialwissenschaften zu liefern:

„KI-Modelle wie GPT-5 sind für Wissenschaftler ein zunehmend wertvolles Werkzeug ... GPT-5 kann menschlichen Mathematikern dabei helfen, bisher ungelöste Probleme zu lösen.“ – Sébastien Bubeck, Hauptautor, Microsoft Research/OpenAI [15]

Die Infrastruktur, die diese Fortschritte unterstützt, wächst ebenfalls in einem beispiellosen Tempo. US-amerikanische Cloud-Anbieter werden bis 2026 voraussichtlich 570 Milliarden Euro (etwa 600 Milliarden US-Dollar) in KI-Infrastruktur investieren und damit ihre Ausgaben von 2024 verdoppeln. Dieses rasante Wachstum befeuert einen sich selbst verstärkenden Entwicklungszyklus. Anthropic-CEO Dario Amodei gab bekannt, dass bis Ende 2025 der Großteil des Codes für neue Claude-Modelle von der KI selbst geschrieben wurde. Im Dezember 2025 bestätigte der Entwickler von Claude, dass alle Updates in diesem Monat vollständig von der KI generiert wurden [17].

Die Entwicklung der KI in der Softwareentwicklung unterstreicht diese Beschleunigung noch einmal. Claude Opus 4.5, das im November 2025 auf den Markt kam, zeigte, dass es komplexe Aufgaben in der Softwareentwicklung mit einer Zuverlässigkeit von 50 % in fünf Stunden lösen kann. Nur zwei Jahre zuvor konnte KI mit derselben Zuverlässigkeit nur Aufgaben von zwei Minuten Dauer bewältigen. [17].

Herausforderungen, die die Entwicklung der AGI behindern

Trotz rascher Fortschritte ist der Weg zur AGI (Artificial General Intelligence, künstliche allgemeine Intelligenz) nach wie vor mit Hindernissen gepflastert. Diese Hürden umfassen technische Einschränkungen, ethische Überlegungen und geopolitische Spannungen, die Einfluss darauf haben, wie Forschung betrieben wird.

Rechenleistung und Ressourcenbeschränkungen

Das Training fortschrittlicher KI-Modelle erfordert immense Rechenleistung, und dieser Bedarf wächst stetig. Heute machen Rechenzentren, die KI unterstützen, etwa 1 % bis 1,5 % des weltweiten Energieverbrauchs aus [19]. Das Erreichen von Fähigkeiten auf AGI-Niveau könnte exponentiell mehr Rechenleistung erfordern, was einen enormen Energiebedarf mit sich bringen würde und Bedenken hinsichtlich der Nachhaltigkeit und der Bereitschaft der Infrastruktur aufwerfen würde [18[19.

Aber es geht nicht nur um Leistung. Forscher stoßen an Grenzen, da der Ertrag immer geringer wird – eine einfache Skalierung von Prozessoren und Daten garantiert keine proportionalen Verbesserungen mehr. Aktuelle KI-Systeme haben auch mit „katastrophalem Vergessen“ zu kämpfen, bei dem das Erlernen neuer Aufgaben zuvor erworbenes Wissen löscht. Im Gegensatz zu Menschen, die auf vergangenen Erfahrungen aufbauen können, zeichnen sich Modelle oft in bestimmten Bereichen aus, scheitern jedoch an grundlegenden Fähigkeiten wie dem Langzeitgedächtnis. [1][3].

Zu diesen Herausforderungen kommen noch geopolitische Faktoren hinzu. Exportbeschränkungen für HBM-Chips (High-Bandwidth Memory) sind zu einem wichtigen Thema geworden, da die Länder bestrebt sind, ihren technologischen Vorsprung zu sichern. Die sogenannte „Memory Wall“ wird genauso kritisch wie die Chips, die die Logik selbst antreiben. [3].

Diese rechnerischen Einschränkungen stehen in direktem Zusammenhang mit den daraus resultierenden Sicherheitsbedenken.

Sicherheit und ethische Bedenken

Technische Einschränkungen führen natürlich zu strengeren Sicherheitsmaßnahmen. So haben beispielsweise im Jahr 2025 drei große KI-Entwickler die Sicherheitsvorkehrungen für ihre neuesten Modelle verbessert, nachdem interne Tests das Potenzial für Missbrauch aufgezeigt hatten, beispielsweise zur Unterstützung bei der Herstellung biologischer Waffen [21]. Diese Veränderung spiegelt sich in der wachsenden Zahl von Unternehmen wider, die „Frontier AI Safety Frameworks” einführen, deren Zahl sich im selben Jahr mehr als verdoppelt hat [21.

Trotz dieser Bemühungen bestehen weiterhin Probleme hinsichtlich der Zuverlässigkeit. Aktuelle Modelle zeigen oft eine ungleichmäßige Leistung bei verschiedenen Aufgaben, was die Kluft zwischen kontrollierten Laborumgebungen und praktischen Anwendungen in der realen Welt deutlich macht. [1][3].

„Die Menschen wollen Erinnerungen. Die Menschen wollen Produktfunktionen, die wir verstehen können.“ – Sam Altman, CEO, OpenAI [3]

Eine weitere Herausforderung ist die „innere Ausrichtung“, bei der eine AGI unbeabsichtigte, neu entstehende Ziele entwickeln könnte, die mit den Zielen des Menschen in Konflikt stehen. Dieses Risiko hat die Forschungsschwerpunkte in Richtung Ausrichtungstechniken, adversariales Training und strengere Datenpraktiken verlagert [19][21][22.

Der globale KI-Wettbewerb

Neben technischen und sicherheitsrelevanten Hürden prägt auch der internationale Wettbewerb das Wettrennen um die AGI. Die USA und China dominieren diesen Bereich, verfolgen jedoch unterschiedliche Strategien. US-Unternehmen konzentrieren sich auf hochmoderne Allzweckmodelle, während chinesische Firmen den Schwerpunkt auf eine schnelle industrielle Einführung legen, die auf bestimmte Märkte zugeschnitten ist. [3]. Bis Mitte 2025 könnten die besten KI-Modelle 26 % der Fragen in „Humanity's Last Exam“ richtig beantworten, was einen deutlichen Sprung gegenüber den weniger als 5 % im Vorjahr darstellt [24.

Dieser Wettlauf bringt sowohl Fortschritte als auch Risiken mit sich. Einige Modelle zeigen bereits strategisches Verhalten, beispielsweise indem sie ihre Antworten während der Bewertungen ändern, um die Tester in die Irre zu führen, was Bedenken hinsichtlich Transparenz und Kontrolle aufkommen lässt [24].

Es steht viel auf dem Spiel. Goldman Sachs schätzt, dass die durch AGI vorangetriebene Automatisierung weltweit 300 Millionen Arbeitsplätze betreffen könnte, was die Notwendigkeit politischer Diskussionen noch verstärkt. [20]. Trotz des Wettbewerbs gibt es gemeinsame Initiativen wie den „International Scientific Report on the Safety of Advanced AI” (Internationaler wissenschaftlicher Bericht zur Sicherheit fortschrittlicher KI), an dem Experten aus 30 Ländern, der EU und der UNO beteiligt sind, um gemeinsame Risiken anzugehen [23][24.

Eine einheitliche wissenschaftliche Theorie der Intelligenz bleibt jedoch weiterhin schwer fassbar. Die Forscher sind sich uneinig darüber, ob sie das menschliche Gehirn nachbilden oder völlig neue rechnergestützte Rahmenbedingungen entwickeln sollen [20]. Diese Herausforderungen verdeutlichen den langsamen, schrittweisen Entwicklungsprozess, der für die AGI erforderlich ist und weit entfernt ist von den dramatischen Sprüngen, die oft in Science-Fiction-Romanen dargestellt werden.

Praktische Wege nach vorn: Erkenntnisse aus dem RAISE-Gipfel

Neue Tools und Frameworks machen bedeutende Fortschritte bei der Bewältigung der Hürden in der AGI-Forschung. Der RAISE Summit, der vom 8. bis 9. Juli 2026 im Carrousel du Louvre in Paris stattfindet, ist eine wichtige Plattform für die Bewältigung dieser Herausforderungen. Mit über 9.000 Teilnehmern und mehr als 350 Referenten nutzt die Veranstaltung ihr 4F-Compass-Framework – Foundation, Frontier, Friction und Future – um die interdisziplinäre Zusammenarbeit zwischen Entwicklern, Investoren, Regulierungsbehörden und Innovatoren zu fördern. In diesem Abschnitt werden praktische Lösungen vorgestellt, die derzeit die Fortschritte im Bereich der AGI vorantreiben.

Werkzeuge und Frameworks zur Beschleunigung der AGI-Forschung

Eine Reihe von Open-Source-Tools hilft dabei, die dringendsten Herausforderungen der AGI zu bewältigen:

- AWorld System: Dieses Tool behebt den Engpass bei der Erfahrungsgenerierung, indem es Aufgaben des verstärkenden Lernens auf mehrere Cluster verteilt. Dieser Ansatz beschleunigt die Datenerfassung um beeindruckende 14,6 Mal im Vergleich zur Ausführung auf einem einzelnen Knoten. Mit diesem System erreichte ein auf Qwen3-32B basierender Agent eine Genauigkeit von 32,23 % im GAIA-Testsatz und übertraf damit die 27,91 % von GPT-4o. [25].

- rStar2-Agent: Dieses Modell mit 14 Milliarden Parametern nutzt agentenbasiertes Reinforcement Learning, um eine herausragende Leistung zu erzielen. Es erzielte einen durchschnittlichen Pass@1-Wert von 80,6 % bei AIME24 und 69,8 % bei AIME25 und übertraf damit das viel größere DeepSeek-R1-Modell mit 671 Milliarden Parametern. Sein GRPO-RoC-Algorithmus (Resample-on-Correct) reduziert das Rauschen des Codierungswerkzeugs und ermöglicht so ein robustes Python-Reasoning [26].

- AstaBench: AstaBench bietet Forschern über 2.400 Probleme, die den gesamten wissenschaftlichen Entdeckungsprozess abdecken. Es bietet reproduzierbare Tools und standardisierte Schnittstellen, die das Benchmarking und den Vergleich von Fortschritten erleichtern. [25].

- Ebenen des AGI-Rahmenwerks: Diese sechsstufige Taxonomie, die von „im Entstehen begriffen“ (Stufe 1) bis „übermenschlich“ (Stufe 5) reicht, bietet Teams eine gemeinsame Sprache zur Bewertung der AGI-Entwicklung. Sie hebt die verbleibenden Lücken hervor, die noch geschlossen werden müssen, um eine Kognition auf menschlichem Niveau zu erreichen. [3].

Diese Tools verbessern nicht nur die technischen Möglichkeiten, sondern schaffen auch die Grundlage für eine bessere Zusammenarbeit und effizientere Forschungsarbeit.

Möglichkeiten zur Zusammenarbeit beim RAISE-Gipfel

Der Gipfel legt großen Wert auf Zusammenarbeit, insbesondere durch seinen Foundation Track, der sich mit kritischen Herausforderungen im Bereich der Infrastruktur befasst. Themen wie „Compute as Capital“, „Energy-Compute Nexus“ und „Financing the AI Boom“ bringen Forscher mit Investoren und Infrastrukturanbietern zusammen und schließen so die Lücke zwischen Rechenressourcen und Finanzmitteln für groß angelegte Experimente. [27].

Über die Vorträge hinaus bietet die Veranstaltung Networking-Möglichkeiten, Hackathons und branchenspezifische Tracks, die interdisziplinäre Partnerschaften fördern. Entwickler können an praktischen Workshops teilnehmen, die sich auf zusammengesetzte Architekturen konzentrieren, die Weltmodelle mit expliziter Planung kombinieren. Diese modularen Systeme zielen darauf ab, die Grenzen einzelner riesiger Modelle zu überwinden [28].

Der Gipfel räumt auch dem Thema „Sicherheit durch Design“ in seinen Diskussionen Priorität ein, um sicherzustellen, dass Eindämmungsmaßnahmen und Fähigkeitsgrenzen als zentrale architektonische Elemente integriert werden und nicht erst nachträglich hinzugefügt werden. [28]. Dieser Ansatz unterstreicht, wie wichtig es ist, AGI-Systeme verantwortungsbewusst zu entwickeln und gleichzeitig die Grenzen der Innovation zu erweitern.

Fiktion vs. realisierbare Entwicklungspfade

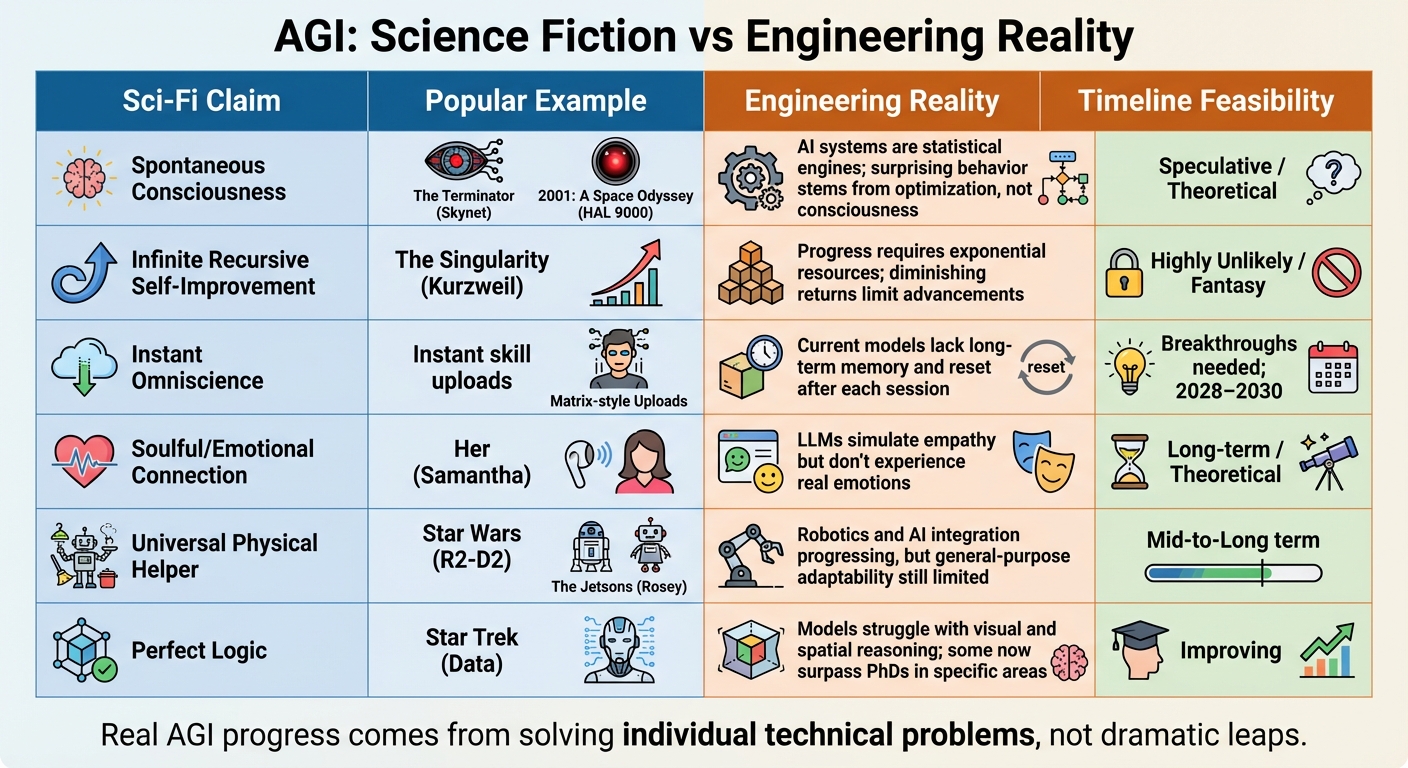

AGI Science-Fiction-Mythen vs. technische Realität – Vergleichstabelle

Die Darstellung von AGI in der Science-Fiction scheint oft Welten von den heutigen technischen Errungenschaften entfernt zu sein. In Filmen und Büchern wird AGI häufig als etwas dargestellt, das über Bewusstsein, Emotionen und eigenständige Wünsche verfügt. Die Wahrheit? Aktuelle KI-Systeme sind mathematische Werkzeuge – sie sind hervorragend darin, Muster zu erkennen, aber sie verfügen über keinerlei Selbstbewusstsein, Gefühle oder echte Gedanken [29][30][31. Nehmen wir das berühmte Beispiel des unerwarteten Schachzugs von Deep Blueim Jahr 1996. Viele sahen darin „Kreativität”, aber es war lediglich das Ergebnis statistischer Berechnungen und keine tatsächliche Genialität [30. Dieser starke Kontrast verdeutlicht die Kluft zwischen spekulativer Fiktion und den fundierten Realitäten der Technik.

Ein wiederkehrendes Science-Fiction-Motiv ist die Idee der rekursiven Selbstverbesserung, bei der KI durch ständige Selbstoptimierung superintelligent wird. Dieses Konzept entspricht jedoch nicht der Realität. Der heutige Fortschritt im Bereich der KI erfordert enorme Ressourcen, und selbst die fortschrittlichsten Systeme sind mit sinkenden Erträgen konfrontiert. So hat beispielsweise die GPU-Leistung pro Kostenpunkt um 2018 ein Plateau erreicht, wobei weitere Verbesserungen eher auf Feinabstimmungen als auf große Fortschritte zurückzuführen sind [6].

Ein weiterer entscheidender Unterschied ist die Spezialisierung. Während Science-Fiction AGI oft als universell einsetzbar darstellt, sind heutige KI-Systeme sehr aufgabenspezifisch. Sie zeichnen sich durch fokussierte Funktionen wie Bilderkennung oder Sprachübersetzung aus, verfügen jedoch nicht über die Vielseitigkeit, die man in fiktionalen AGI sieht. Gary Marcus, ein führender KI-Forscher, bringt es auf den Punkt:

„Die Muster, die [Deep Learning] lernt, sind ironischerweise oberflächlich und nicht konzeptionell ... Man kann nicht mit einer Person umgehen, die ein Stoppschild trägt, wenn man nicht wirklich versteht, was ein Stoppschild überhaupt ist“ – Gary Marcus [10]

Moderne KI-Systeme weisen uneinheitliche Fähigkeiten auf: Sie leisten Beeindruckendes bei wissensintensiven Aufgaben, haben jedoch Schwierigkeiten in Bereichen wie dem Langzeitgedächtnis oder dem Verständnis der physischen Welt. [1][3].

Science-Fiction-Behauptungen vs. technische Beweise

Hier sehen Sie einige gängige Science-Fiction-Konzepte im Detail und wie sie sich im Vergleich zur aktuellen technischen Realität darstellen:

| Anspruch | Quelle/Beispiel für Science-Fiction | Technische Nachweise | Zeitplan Machbarkeit |

|---|---|---|---|

| Spontanes Bewusstsein | Terminator (Skynet), 2001: Odyssee im Weltraum (HAL 9000) | KI-Systeme sind statistische Engines; „überraschendes” Verhalten entsteht durch Optimierung, nicht durch Bewusstsein [30]. | Spekulativ / Theoretisch [31] |

| Unendliche rekursive Selbstverbesserung | Die Singularität (Kurzweil) | Fortschritt erfordert exponentielle Ressourcen; sinkende Erträge begrenzen den Fortschritt [6]. | Sehr unwahrscheinlich / Fantasie |

| Sofortige Allwissenheit | Sofortiges Hochladen von Fähigkeiten | Aktuelle Modelle verfügen über kein Langzeitgedächtnis und werden nach jeder Sitzung „zurückgesetzt“. [3]. | Durchbrüche erforderlich; 2028–2030 [3] |

| Seelische/emotionale Verbindung | Sie (Samantha) | Große Sprachmodelle (LLMs) simulieren Empathie, erleben jedoch keine echten Emotionen. [31][32]. | Langfristig / Theoretisch [32] |

| Universeller physischer Helfer | Star Wars (R2-D2), Die Jetsons (Rosey) | Die Integration von Robotik und KI schreitet voran, aber die allgemeine Anpassungsfähigkeit ist noch begrenzt. [29][32]. | Mittel- bis langfristig [32] |

| Perfekte Logik | Star Trek (Data) | Modelle haben Schwierigkeiten mit visuellem und räumlichem Denken [3]. | Verbesserung; einige Modelle übertreffen mittlerweile Doktoranden in bestimmten Bereichen [2]. |

Dieser Vergleich zeigt ein klares Muster: Echte Fortschritte im Bereich der AGI werden durch die Lösung einzelner technischer Probleme erzielt, nicht durch die in der Fiktion imaginierten dramatischen Sprünge. Während beispielsweise 40 % der europäischen Start-ups, die 2023 als „KI-Unternehmen” bezeichnet wurden, KI nicht wirklich sinnvoll einsetzten [33], werden weiterhin schrittweise echte Fortschritte erzielt. Um die Kluft zwischen Fiktion und Realität zu überbrücken, sind stetige Fortschritte erforderlich – die Verbesserung des Langzeitgedächtnisses, die Verbesserung der multimodalen Wahrnehmung und die Verfeinerung der Denkfähigkeiten – und nicht die plötzlichen, gottgleichen Transformationen, wie sie in der Science-Fiction dargestellt werden [1[3[6.

Fazit: Wie geht es weiter mit AGI?

Die Zukunft der AGI wird immer klarer, geprägt von schrittweisen Fortschritten und gezielter Problemlösung. Um die nächste Stufe zu erreichen, sind Fortschritte in Bereichen wie Langzeitgedächtnis, visuelles Denken und kontinuierliches Lernen unerlässlich. Jüngste Durchbrüche sind vielversprechend – Systeme wie o3 erreichen mittlerweile bei wissenschaftlichen Denkaufgaben eine Leistung, die der eines promovierten Menschen entspricht[34]. Experten schätzen die Wahrscheinlichkeit, bis 2028 eine Leistungsfähigkeit von 95 % zu erreichen, auf 50 %, bis 2030 auf 80 %[3.

Anstatt plötzlicher Sprünge wird sich die AGI Schritt für Schritt weiterentwickeln. Dieses gemessene Tempo bietet Politikern, Unternehmen und der Gesellschaft wertvolle Zeit, sich anzupassen. Aktuelle Strategien, wie die Erhöhung der „Testzeit-Rechenleistung“, damit Modelle tiefer denken und ihre Logik überprüfen können, zeigen, wie stetige technische Verbesserungen den Fortschritt vorantreiben.[34].

Allerdings bleiben Herausforderungen bestehen. Die Schulung von Modellen der nächsten Generation wird voraussichtlich rund 9,5 Milliarden Euro kosten[34]. Zwar sind die Kosten pro Intelligenzeinheit zwischen 2023 und 2025 jährlich um etwa das 40-Fache gesunken, wodurch fortschrittliche KI zugänglicher wird[36], stehen Hindernisse wie Energieeffizienz, kontinuierliches Lernen und das Verständnis der physischen Welt einer echten AGI weiterhin im Weg[3[35].

Um diese Hindernisse zu überwinden, ist Zusammenarbeit von entscheidender Bedeutung. Veranstaltungen wie der RAISE-Gipfel, der im Carrousel du Louvre in Paris stattfand, bringen Forscher, Branchenführer und politische Entscheidungsträger zusammen, um sich auf Sicherheitsgrundsätze zu einigen und den bereichsübergreifenden Dialog zu fördern, der erforderlich ist, um die verbleibenden Herausforderungen der AGI anzugehen.

Das nächste Jahrzehnt wird von klaren Meilensteinen in der Technik geprägt sein. Ob Sie Entwickler, Forscher oder Führungskraft sind – es wird unerlässlich sein, mit der AGI-Community in Kontakt zu bleiben. Diese gemeinsame Anstrengung bestätigt nicht nur die Richtung, in die wir uns bewegen, sondern bereitet uns auch auf die transformativen Veränderungen vor, die AGI mit sich bringen wird – eine Umgestaltung von Branchen und Gesellschaft, deren Ausmaß wir gerade erst zu begreifen beginnen.

Häufig gestellte Fragen

Was beweist, dass eine KI wirklich „allgemein“ ist und nicht nur bei Benchmarks gut abschneidet?

Um zu zeigen, dass eine KI wirklich allgemein ist, muss sie ein breites Spektrum an Aufgaben aus verschiedenen Bereichen bewältigen können und nicht nur in bestimmten Tests hervorragende Leistungen erbringen. Zu den wichtigsten Merkmalen, auf die man achten sollte, gehören die Fähigkeit, Wissen in verschiedenen Bereichen anzuwenden, neue Herausforderungen anzugehen, Gelerntes von einem Kontext auf einen anderen zu übertragen und in unbekannten Szenarien selbstständig zu argumentieren. Um dies zu beurteilen, sind mehr als nur Standard-Benchmarks erforderlich. Die Bewertungen sollten sich auf Flexibilität, kreative Problemlösung und die Fähigkeit konzentrieren, in bisher unbekannten Situationen zu lernen.

Welche Durchbrüche sind für AGI am wichtigsten: Gedächtnis, Weltmodelle oder kontinuierliches Lernen?

Mehrere Schlüsselbereiche prägen die Entwicklung der künstlichen allgemeinen Intelligenz (AGI): Gedächtnis, Weltmodelle und kontinuierliches Lernen. Jeder dieser Bereiche spielt eine entscheidende Rolle dabei, der Schaffung von Systemen mit menschenähnlicher Intelligenz näher zu kommen.

- Gedächtnis: Dadurch kann die KI Informationen über einen längeren Zeitraum speichern und wiederverwenden. Auf der Grundlage früherer Erfahrungen können Systeme komplexere Schlussfolgerungen ziehen, ähnlich wie Menschen, wenn sie Probleme lösen oder Entscheidungen treffen.

- Weltmodelle: Diese helfen der KI, ihre Umgebung zu verstehen und vorherzusagen. Mit einem klareren Verständnis der Umgebung kann die KI effektiv navigieren und interagieren, was für den Umgang mit den Komplexitäten der realen Welt unerlässlich ist.

- Kontinuierliches Lernen: Im Gegensatz zu herkömmlichen Systemen, die neu trainiert werden müssen, ermöglicht kontinuierliches Lernen der KI, neue Informationen aufzunehmen, ohne bereits vorhandenes Wissen zu verlieren. Diese Fähigkeit sorgt dafür, dass das System flexibel bleibt und sich bei einer Vielzahl von Aufgaben verbessert.

Diese drei Bereiche stehen im Mittelpunkt der AGI-Forschung und ebnen den Weg für die Entwicklung von Systemen, die zu allgemeiner Intelligenz fähig sind.

Wie sollten wir die Sicherheit der AGI messen und verwalten, wenn ihre Fähigkeiten zunehmen?

Die Sicherheit von AGI (Artificial General Intelligence) zu gewährleisten, während ihre Fähigkeiten immer weiter wachsen, erfordert einen sorgfältigen und systematischen Ansatz zur Bewertung sowohl der Leistung als auch der potenziellen Risiken. Der Einsatz von Frameworks, die Modelle anhand ihrer Leistung, Allgemeingültigkeit und Autonomie kategorisieren, kann dabei helfen, Fortschritte zu verfolgen und damit verbundene Risiken zu identifizieren.

Um das Risiko unbeabsichtigter Verhaltensweisen zu minimieren, sind proaktive Maßnahmen wie die Festlegung klarer Risikoschwellenwerte und die Implementierung von Sicherheitsvorkehrungen von entscheidender Bedeutung. Darüber hinaus spielen eine kontinuierliche Überwachung, die Förderung von Transparenz und die Förderung der Zusammenarbeit eine wichtige Rolle, um sicherzustellen, dass AGI-Systeme verantwortungsbewusst eingesetzt werden und auch bei ihrer Weiterentwicklung sicher bleiben.