De EU-wet inzake kunstmatige intelligentie geeft een nieuwe vorm aan de wereldwijde regelgeving op het gebied van kunstmatige intelligentie, en Amerikaanse bedrijven moeten hier aandacht aan besteden. Hier is waarom:

- De wet is van toepassing op alle bedrijven – ongeacht hun locatie – die AI-systemen op de markt brengen in de EU of waarvan de AI-output daar wordt gebruikt.

- Risico's bij niet-naleving omvatten boetes tot € 35 miljoen of 7% van de wereldwijde jaaromzet.

- De wet categoriseert AI-systemen op basis van risico (minimaal, beperkt, hoog en onaanvaardbaar) en stelt strenge verplichtingen voor systemen met een hoog risico.

- De belangrijkste deadlines beginnen al op 2 februari 2025, waarbij volledige naleving voor de meeste risicovolle systemen vereist is tegen 2 augustus 2026.

Voor Amerikaanse bedrijven is het naleven van deze regels geen optie. Door de omvang en invloed van de EU-markt worden deze normen een wereldwijde benchmark. Onmiddellijke maatregelen zijn onder meer het opzetten van een AI-governancesysteem, het herzien van contracten en het instellen van voortdurende nalevingscontrole.

Inzicht in de EU-wet inzake kunstmatige intelligentie: belangrijke feiten en nalevingsvereisten | AI Literacy Series

sbb-itb-e314c3b

Wie moet zich hieraan houden: bepalen of de EU-AI-wet van toepassing is op uw bedrijf

De EU-wet inzake kunstmatige intelligentie heeft een grote impact tot ver buiten de grenzen van Europa. Het is van cruciaal belang om te weten of deze wet van toepassing is op uw bedrijf, vooral als u actief bent in de VS. Hieronder leest u meer over hoe uw activiteiten kunnen leiden tot nalevingsverplichtingen.

Zakelijke activiteiten die naleving vereisen

Het toepassingsgebied van de wet is niet beperkt tot de plaats waar een bedrijf is gevestigd. In plaats daarvan richt de wet zich op de werking van AI-systemen en de impact daarvan. Zoals KPMG het formuleert:

"De EU-wet inzake kunstmatige intelligentie is van toepassing op veel Amerikaanse bedrijven, mogelijk zelfs op bedrijven die niet fysiek in de EU aanwezig zijn." [6]

Wat leidt dan tot naleving? Als u AI-producten of -diensten verkoopt in de EU, AI-gestuurde software aanbiedt via e-commerceplatforms of algemene AI-modellen levert aan Europese klanten, valt u onder de wet. Zelfs als uw AI-systeem werkt vanaf servers in de VS, valt het onder de wet als de output ervan – zoals voorspellingen, aanbevelingen of beslissingen – wordt gebruikt in de EU. Zo zou bijvoorbeeld een Amerikaans wervingsplatform dat cv's screent voor een Duits kantoor of een algoritme voor kredietwaardigheid dat leningaanvragen van EU-inwoners beoordeelt, aan de wet moeten voldoen [6].

De verwerking van persoonsgegevens van EU-ingezetenen is een andere belangrijke trigger. Of u deze gegevens nu analyseert voor marketing, risicobeoordelingen of klantenservice, de wet is van toepassing. Bovendien is naleving verplicht als uw AI-technologie is ingebouwd in een product dat wordt verkocht door een in de EU gevestigd bedrijf [6].

Directe versus indirecte nalevingsvereisten

Wat u moet doen om aan de regels te voldoen, hangt af van uw rol in de AI-waardeketen. Hier volgt een overzicht:

- Aanbieders: Als u AI-systemen ontwikkelt en deze onder uw eigen naam op de EU-markt brengt, gelden voor u de strengste regels. Denk hierbij aan conformiteitsbeoordelingen, risicobeheersystemen en gedetailleerde technische documentatie [6].

- Implementatoren: Bedrijven die AI-systemen onder hun verantwoordelijkheid gebruiken, hebben een andere reeks verantwoordelijkheden. Deze omvatten het monitoren van de prestaties van het systeem, het trainen van personeel in de werking van de AI en het melden van ernstige incidenten aan de autoriteiten als de AI in de EU wordt gebruikt of als de output ervan EU-gebruikers bereikt. [3].

- Importeurs en distributeurs: Als u AI-systemen vanuit de VS naar de EU invoert, moet u de naleving controleren, controleren of er CE-markeringen aanwezig zijn en gegevens bijhouden om aan te tonen dat alles in orde is. [4].

Er is ook een belangrijk onderscheid om in gedachten te houden: als u een AI-systeem een nieuwe merknaam geeft of ingrijpend wijzigt, kunt u van implementator veranderen in aanbieder. Deze verandering brengt strengere verplichtingen met zich mee. Zoals Vivien F. Peaden van Baker Donelson uitlegt:

"Een implementator kan worden geherclassificeerd als 'leverancier' van risicovolle AI-systemen als hij de AI-systemen onder zijn eigen naam en merk exploiteert of de AI-systemen op een andere manier aanpast voor onbedoelde doeleinden." [3]

Voor Amerikaanse ontwikkelaars van algemene AI-modellen zijn de risico's ook aanzienlijk. Als een derde partij uw model gebruikt en beschikbaar stelt in de EU, kunt u worden aangemerkt als aanbieder, tenzij u de distributie ervan in de EU expliciet hebt verboden [8].

Inzicht in deze rollen en triggers is essentieel om effectief te kunnen voldoen aan de vereisten van de EU-wet inzake kunstmatige intelligentie.

De 4 risicocategorieën: hoe de EU-AI-wet AI-systemen classificeert

De EU-AI-wet deelt AI-systemen in vier risiconiveaus in – minimaal, beperkt, hoog en onaanvaardbaar – om te bepalen hoeveel regulering elke categorie vereist. Zoals uitgelegd door Mario F. Ayoub, Jessica L. Copeland en Sarah Jiva van Bond Schoeneck & King PLLC:

"De wet hanteert een risicogebaseerde benadering, waarbij de verplichtingen variëren naargelang een AI-systeem wordt beschouwd als een minimaal, beperkt, hoog of onaanvaardbaar risico." [7]

Deze structuur helpt bedrijven inzicht te krijgen in de nalevingsmaatregelen die nodig zijn voor hun AI-systemen. Hieronder volgt een nadere beschrijving van elke categorie.

Onaanvaardbaar risico: verboden AI-systemen

Sommige AI-toepassingen worden als te schadelijk beschouwd voor gebruik in de EU en zullen vanaf 2 februari 2025 worden verboden [7]. Het gaat onder meer om systemen die gedrag manipuleren door middel van subliminale technieken, kwetsbare groepen uitbuiten of sociale scores gebruiken. Andere verboden toepassingen zijn het ongeoorloofd verzamelen van gezichtsbeelden van onlineplatforms of camerabeelden om herkenningsdatabases aan te leggen, en voorspellende politiesystemen die personen profileren op basis van aangeboren kenmerken. Real-time biometrische identificatie in openbare ruimten is ook verboden, behalve voor beperkte wetshandhavingstoepassingen, zoals het opsporen van vermiste kinderen of het voorkomen van een dreigende terroristische aanslag [6].

Bedrijven die deze technologieën gebruiken, moeten hun activiteiten onmiddellijk staken of krijgen te maken met hoge boetes - tot € 35 miljoen of 7% van hun wereldwijde jaaromzet. [10].

Hoog risico: vereisten voor kritieke AI-toepassingen

Hoewel de wet de gevaarlijkste systemen verbiedt, staat hij risicovolle AI toe onder strikte voorwaarden. Volgens KPMG:

"AI-systemen met een hoog risico vormen een verhoogd risico voor de gezondheid en veiligheid of rechten van de consument. Dergelijke systemen zijn toegestaan op de EU-markt, mits ze voldoen aan bepaalde verplichte eisen en een conformiteitsbeoordeling." [6]

Systemen met een hoog risico kunnen worden onderverdeeld in twee groepen. De eerste groep omvat AI die is geïntegreerd in gereguleerde producten, zoals medische hulpmiddelen, voertuigen, speelgoed en machines, die al onder de gezondheids- en veiligheidswetgeving van de EU vallen [11]. De tweede groep omvat AI die wordt gebruikt in gevoelige gebieden zoals werving, kredietbeoordeling, kritieke infrastructuur (bijv. water- en energiesystemen), toelating tot het onderwijs, wetshandhaving, grenscontrole en gerechtelijke administratie [9.

Aanbieders van risicovolle systemen moeten aan strenge eisen voldoen voordat ze hun producten op de markt brengen. Deze eisen omvatten onder meer het implementeren van risicobeheersystemen, het waarborgen van gegevensbeheer om vooringenomenheid te verminderen, het bijhouden van technische documentatie, het mogelijk maken van menselijk toezicht en het automatisch registreren van beslissingen. [12]. Bovendien moeten deze systemen worden geregistreerd in een speciale EU-database en worden onderworpen aan conformiteitsbeoordelingen. Niet-naleving kan leiden tot boetes van maximaal 15 miljoen euro of 3% van de wereldwijde jaaromzet. De meeste risicovolle systemen moeten uiterlijk op 2 augustus 2026 aan de eisen voldoen [10.

Niet alle AI-systemen die in bijlage III worden genoemd, vallen echter onder de regelgeving voor hoge risico's. Als een systeem alleen beperkte taken uitvoert, menselijke beslissingen ondersteunt of voorbereidend werk verricht – zoals het opmaken van cv's in plaats van het screenen of rangschikken van kandidaten – is het vrijgesteld van deze vereisten.

Beperkt en minimaal risico: lichtere vereisten en vrijstellingen

AI-systemen die minder risico's met zich meebrengen, hebben minder verplichtingen. Systemen met een beperkt risico moeten voldoen aan transparantievereisten, zoals chatbots die hun niet-menselijke aard bekendmaken of door AI gegenereerde inhoud die duidelijk als synthetisch wordt gelabeld. Aan de andere kant gelden er voor systemen met een minimaal risico, waaronder tools zoals spamfilters of door AI aangestuurde videogames, geen verplichte regelgeving. [6].

Hoewel de wet vrijwillige gedragscodes voor deze systemen aanmoedigt, blijft naleving optioneel. [6]. Systemen met een minimaal risico vormen het merendeel van de AI-toepassingen die momenteel in gebruik zijn en profiteren van deze lichtere vereisten.

Belangrijke data en sancties: wat gebeurt er als u zich niet aan de regels houdt?

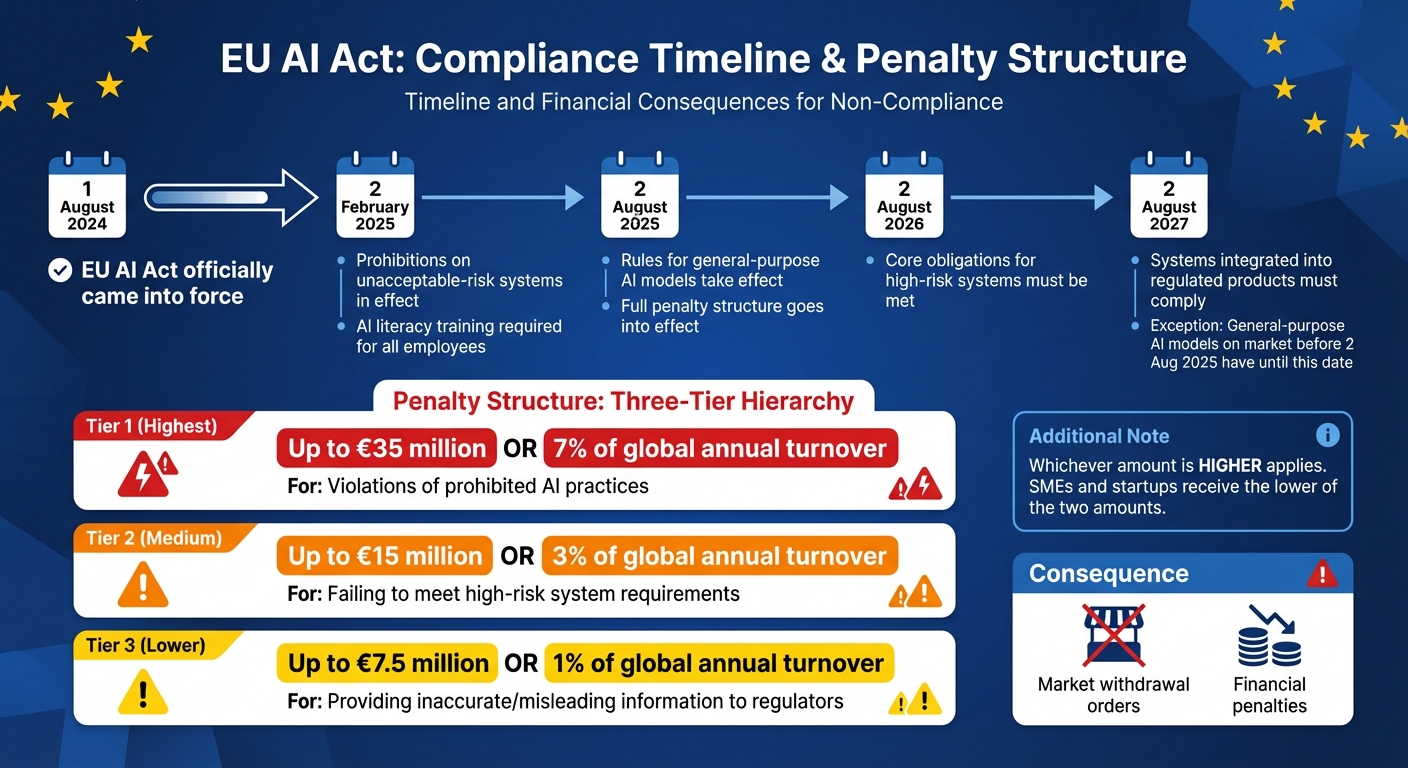

Tijdlijn voor naleving van de EU-wet inzake kunstmatige intelligentie en sanctiestructuur voor Amerikaanse bedrijven

Voor Amerikaanse bedrijven die te maken hebben met het Brusselseffect is het van cruciaal belang om op de hoogte te blijven van de deadlines en sancties van de EU-AI-wet. De wet is officieel in werking getreden op 1 augustus 2024 [15][17]. Het niet naleven van deze deadlines kan leiden tot hoge boetes en beperkingen op de markttoegang.

Deadlines voor naleving die u moet kennen

De EU-wet inzake kunstmatige intelligentie hanteert een gefaseerd tijdschema op basis van het risiconiveau van AI-systemen. Hieronder volgt een overzicht van de belangrijkste data:

- 2 februari 2025: Verboden op systemen met een "onaanvaardbaar risico", zoals sociale scores of emotieherkenning op de werkplek, zijn al van kracht. Bedrijven die deze technologieën gebruiken, moeten hier onmiddellijk mee stoppen. [7][20].

- 2 augustus 2025: Regels voor algemene AI-modellen en de volledige sanctiestructuur treden in werking [5][7].

- 2 augustus 2026: De kernverplichtingen voor systemen met een hoog risico moeten tegen deze datum zijn nagekomen.

- 2 augustus 2027: Systemen die in gereguleerde producten zijn geïntegreerd, moeten op dat moment aan de voorschriften voldoen [5][7].

Er is een opmerkelijke uitzondering voor aanbieders van algemene AI. Als hun modellen al vóór 2 augustus 2025 op de markt waren, hebben ze tot 2 augustus 2027 de tijd om aan de regels te voldoen. [16][17]. Bovendien moeten bedrijven vanaf 2 februari 2025 ervoor zorgen dat alle werknemers die betrokken zijn bij AI-activiteiten een goede opleiding in "AI-geletterdheid" krijgen [16].

Deze deadlines zijn strikt, zonder uitstel. Als u eenmaal de tijdlijn begrijpt, is het net zo belangrijk om te weten wat de sancties zijn bij niet-naleving.

Financiële sancties en marktbeperkingen

De EU-AI-wet voert een drieledig boetesysteem in. Boetes worden berekend als een vast bedrag of als een percentage van de wereldwijde jaaromzet, afhankelijk van welk bedrag het hoogst is. [18][19]. Hieronder volgt een overzicht van de sancties:

- Tot € 35 miljoen of 7% van de wereldwijde jaaromzet voor overtredingen van verboden AI-praktijken [5][20].

- Tot € 15 miljoen of 3% van de wereldwijde omzet voor het niet voldoen aan de vereisten voor risicovolle systemen [5].

- Tot € 7,5 miljoen of 1% van de wereldwijde omzet voor het verstrekken van onjuiste of misleidende informatie aan toezichthouders [20].

Naast boetes kunnen bedrijven die zich niet aan de regels houden, worden verplicht om hun AI-systemen uit de EU-markt te halen. [5][20]. Voor kleinere bedrijven, zoals kmo's en start-ups, geldt de laagste van de twee boetes (vast bedrag of percentage), wat enige verlichting biedt [18].

Deze sancties, in combinatie met strikte deadlines, onderstrepen het belang van naleving voor elk Amerikaans bedrijf dat actief is in de EU. Het negeren van deze vereisten is geen optie.

Hoe voorbereiden: stappen die Amerikaanse bedrijven nu moeten nemen

Voor Amerikaanse bedrijven vereist het aanpassen aan de EU AI-wet onmiddellijke actie. Door het proces op te splitsen in duidelijke stappen – zoals het opzetten van een governancesysteem, het herzien van contracten en het instellen van voortdurende monitoring – kan naleving beter beheersbaar worden gemaakt.

Een AI-governancesysteem opzetten

Begin met het inventariseren van alle AI-systemen die uw bedrijf gebruikt. Dit omvat zowel intern ontwikkelde systemen, systemen waarvoor een licentie is aangeschaft bij leveranciers, als AI die is ingebouwd in producten die u verkoopt. Nadat u alle systemen hebt geïnventariseerd, classificeert u elk systeem in een van de vier risicocategorieën: onaanvaardbaar, hoog, beperkt of minimaal [6][4][21]. Er zijn meer dan 138 voorbeelden van risicovolle AI-toepassingen in sectoren als de gezondheidszorg, de financiële sector en de recruitmentbranche [2].

Bepaal vervolgens de rol van uw bedrijf onder de wet. Bent u een aanbieder (ontwikkelaar van AI), gebruiker (toepasser van AI), importeur (invoerder van AI in de EU) of distributeur (wederverkoper van AI)? Elke rol brengt specifieke wettelijke verantwoordelijkheden met zich mee [5][4][22].

Nadat u uw systemen en rollen in kaart hebt gebracht, wijst u toezichthoudend personeel aan om het gebruik van AI te controleren, menselijke betrokkenheid te waarborgen en afwijkingen onmiddellijk aan te pakken. [5][2]. Voor systemen met een hoog risico is een risicobeheersysteem nodig om voorzienbare risico's te identificeren en te minimaliseren. [4][2]. Dit omvat het waarborgen dat trainings-, validatie- en testdatasets onbevooroordeeld en representatief zijn [5][2]. Zoals KPMG benadrukt:

"De Chief Information Security Officer (CISO) is een belangrijke leidinggevende functie die het meest zal worden beïnvloed door de EU-wet inzake kunstmatige intelligentie, aangezien deze wet gevolgen zal hebben voor de manier waarop bedrijven AI-technologieën ontwikkelen en implementeren en hun gegevens beveiligen." [6]

Om het bestuur te versterken, moeten interne kaders worden afgestemd op normen zoals ISO 42001, het NIST AI Risk Management Framework of de OESO-richtlijnen. [6][23]. Bij het beheer van meerdere AI-systemen kunnen geautomatiseerde detectietools het inventarisatieproces vereenvoudigen [6].

Zodra uw governancesysteem is ingevoerd, moet u de juridische en technische kaders aanpassen aan deze veranderingen.

Herziening van contracten en technische documentatie

Contracten en documentatie bijwerken om te voldoen aan de vereisten van de EU-AI-wet. Inkoopcontracten met leveranciers controleren om ervoor te zorgen dat zij de nodige technische documentatie en gebruiksinstructies voor risicovolle systemen verstrekken. [5][14]. Definieer duidelijk de rollen en verantwoordelijkheden in serviceovereenkomsten, of u nu een leverancier of een implementator bent. [5][2. Controleer bij AI-modellen van derden of de trainingsgegevens accuraat zijn en of u beschikt over de vereiste intellectuele eigendoms- en privacyrechten [2].

Voor systemen met een hoog risico moet de technische documentatie controleerbare logboeken, beschrijvingen van risicobeheer en verslagen van opleidings- en testprocessen bevatten. [5][4]. Mayer Brown adviseert:

"De kosten voor het genereren van technische documentatie zijn relatief laag als deze vanaf het begin in de AI-tool worden ingebouwd." [2]

Integreer logboekregistratie en metadatatracking in uw AI-systemen om de prestaties in realtime te monitoren. Dit omvat het controleren op eerlijkheid, nauwkeurigheid, vooringenomenheid en cyberbeveiligingsrisico's [2].

Werk uw Service Level Agreements (SLA's) bij en voeg clausules toe over monitoring na het in de handel brengen. Leveranciers moeten worden verplicht om ernstige incidenten of modelafwijkingen te melden die van invloed kunnen zijn op de naleving. [5][4][2]. Als u risicovolle systemen levert, moet u implementators gedetailleerde instructies geven over de beperkingen van het systeem en de vereisten voor menselijk toezicht [14]. Transparantieverslagen waarin de mogelijkheden en beperkingen van het systeem worden beschreven, zijn ook essentieel [2].

Nu de contracten en documentatie in orde zijn, is de volgende stap om ons te richten op het handhaven van de naleving.

Naleving handhaven door middel van regelmatige beoordelingen

Voortdurende evaluatie is van cruciaal belang om aan de voorschriften te blijven voldoen. De EU-wet inzake kunstmatige intelligentie schrijft post-market monitoring voor risicovolle systemen voor, waarbij bedrijven verplicht zijn om gedurende de levensduur van het systeem prestatiegegevens te verzamelen en te analyseren [5][4]. Een belangrijke uitdaging hierbij is modelafwijking, waarbij AI-modellen na verloop van tijd aan nauwkeurigheid of eerlijkheid inboeten [2. Mayer Brown legt uit:

"De EU-wet vereist het testen, monitoren en controleren van risicovolle AI, zowel vóór als na de implementatie ervan... De reden voor deze vereiste is het probleem van modelafwijkingen." [2]

Integreer realtime monitoring in uw AI-systemen. Stel processen in om regelmatig te testen op nauwkeurigheid, vooringenomenheid en modelafwijkingen. [2]. Documenteer alle prestatieproblemen of incidenten, aangezien deze gegevens van cruciaal belang zijn om verantwoording af te leggen aan toezichthouders [5][4]. Systemen met een hoog risico moeten ook een "kill switch" bevatten om ze uit te schakelen als de naleving niet kan worden hersteld [2].

Voer regelmatig gap-analyses uit om uw beleid te vergelijken met de vereisten van de wet en eventuele tekortkomingen aan te pakken voordat de deadlines verstrijken. [6][23][21]. Gebruik tools zoals de IAPP Global AI Law and Policy Tracker of de EU AI Act Compliance Matrix om op de hoogte te blijven van wijzigingen in de regelgeving. Voor bedrijven die meerdere AI-systemen beheren, kunnen geautomatiseerde oplossingen het bijhouden van de naleving en het workflowbeheer vereenvoudigen. Zoals KPMG opmerkt:

"Het gebruik van een geautomatiseerde oplossing voor het beheer van verschillende aspecten van compliance mapping, het bijhouden van verplichtingen en workflowbeheer kan helpen bij het ondersteunen en opschalen van verschillende governance-activiteiten." [6]

Amerikaanse bedrijven kunnen ook toetreden tot het 'AI-pact' van de Europese Commissie, een vrijwillig initiatief om belangrijke verplichtingen alvast op zich te nemen voordat deze wettelijk worden opgelegd. Deze proactieve stap vermindert niet alleen de nalevingsrisico's, maar positioneert uw bedrijf ook als leider op het gebied van verantwoorde AI-praktijken.

Conclusie: EU-AI-regelgeving gebruiken als zakelijk voordeel

De EU-wet inzake kunstmatige intelligentie biedt vooruitstrevende Amerikaanse bedrijven de kans om voorop te blijven lopen. Door vroegtijdig aan de wet te voldoen, krijgen ze gegarandeerd toegang tot een consumentenmarkt van 450 miljoen mensen en lopen ze voor op concurrenten die wachten met aanpassing. [25][26].

Zoals Peter Stockburger, Office Managing Partner bij Dentons, het verwoordt:

"Organisaties die het goed aanpakken, kunnen profiteren van marktaandeel en inspelen op de groeiende behoeften van klanten, partners en regelgevende instanties, die steeds vaker van organisaties verwachten dat ze AI alleen op een verantwoorde, veilige en ethische manier ontwikkelen en implementeren." [24]

Werken volgens een uniform, EU-conform model is niet alleen kostenefficiënt, maar beschermt bedrijven ook tegen de complexiteit van het navigeren tussen verschillende normen. Het bereidt hen ook voor op de groeiende golf van Amerikaanse staatswetten die de EU-principes weerspiegelen. Tegen 2025 zullen naar verwachting ongeveer 1.000 AI-gerelateerde wetsvoorstellen in de Amerikaanse staten in behandeling zijn, waardoor het EU-kader een betrouwbare basis vormt voor naleving. [1][13][25][26. De financiële en regelgevende stabiliteit die dit biedt, weegt zwaarder dan het risico om achterop te raken.

Het niet naleven van deze regels leidt tot hoge boetes, mogelijk verlies van markttoegang en verminderd vertrouwen. [10][25]. Bovendien controleren wereldwijde B2B-partners leveranciers steeds vaker om er zeker van te zijn dat zij over krachtige maatregelen voor gegevensbeheer beschikken voordat zij partnerschappen aangaan [25.

Door de risicogebaseerde aanpak van de wet over te nemen, kunnen Amerikaanse bedrijven zich positioneren als leiders in wereldwijd AI-beleid in plaats van achterop te lopen. Het Center for AI Policy benadrukt dit punt:

"Als de VS in de huidige politieke impasse blijft zitten met betrekking tot het AI-beleid, zullen haar bedrijven in feite door de EU worden gereguleerd." [1]

Early adopters kunnen een duidelijk voordeel behalen door zich te committeren aan ethische AI-praktijken. Dit helpt niet alleen om marktaandeel te veroveren op tragere concurrenten, maar bouwt ook vertrouwen op bij klanten wereldwijd. De EU AI Act stelt de norm voor verantwoorde AI-praktijken, en bedrijven die nu actie ondernemen, zullen de toekomst van AI-governance vormgeven in plaats van later haastig aanpassingen te moeten doorvoeren. Door deze proactieve stap te zetten, verzekeren Amerikaanse bedrijven zich van hun plaats op de wereldmarkt en lopen ze voorop in de ontwikkeling van verantwoorde AI.

Veelgestelde vragen

Vallen we onder de EU-AI-wet, ook al hebben we geen EU-kantoor?

Ja, Amerikaanse bedrijven kunnen nog steeds onderworpen zijn aan de EU-AI-wet, zelfs als ze geen kantoor in de EU hebben. De verordening is van toepassing op AI-systemen die van invloed zijn op personen of markten binnen de EU, dankzij het extraterritoriale toepassingsgebied ervan. Met andere woorden, als een bedrijf zich richt op of actief is in de EU, is naleving vereist, ongeacht of het daar fysiek aanwezig is.

Hoe weten we of onze AI 'risicovol' is of vrijgesteld?

Om te bepalen of uw AI-systeem onder de categorie met hoog risico valt in de EU-AI-wet, moet u het beoogde doel, de sector waarin het wordt gebruikt en de mogelijke impact ervan onderzoeken. Dit zijn de belangrijkste factoren die in de richtlijnen van de wet worden genoemd voor het identificeren van systemen met een hoog risico. Raadpleeg voor meer informatie bronnen waarin deze classificaties worden uitgelegd en wat ze betekenen voor het voldoen aan de nalevingsvereisten.

Wat moeten we als eerste doen om klaar te zijn voor 02/02/2025?

Om u voor te bereiden op de inwerkingtreding van de EU-AI-wet op 2 februari 2025, moet u zich eerst vertrouwd maken met het toepassingsgebied en de vereisten ervan. De eerste stap is om te bepalen of uw AI-systemen onder de verordening vallen, met name als ze van invloed zijn op de EU-markt.

Bepaal vervolgens uw positie in de AI-waardeketen: bent u een aanbieder, gebruiker of importeur? Elke rol brengt specifieke verantwoordelijkheden met zich mee, dus het is cruciaal om te begrijpen waar u thuishoort.

Zodra dat duidelijk is, kunt u zich richten op het ontwikkelen van nalevingsstrategieën. Dit omvat het implementeren van grondige risicobeheerprocessen, het bijhouden van gedetailleerde documentatie en ervoor zorgen dat uw systemen aan de vereiste normen voldoen. Als u over enig aspect twijfelt, is het raadzaam om deskundigen te raadplegen om effectief door de complexiteit van de regelgeving te navigeren.