La loi européenne sur l'IA remodèle les réglementations mondiales en matière d'IA, et les entreprises américaines doivent y prêter attention. Voici pourquoi :

- La loi s'applique à toute entreprise, quel que soit son emplacement, qui commercialise des systèmes d'IA dans l'UE ou dont les résultats d'IA y sont utilisés.

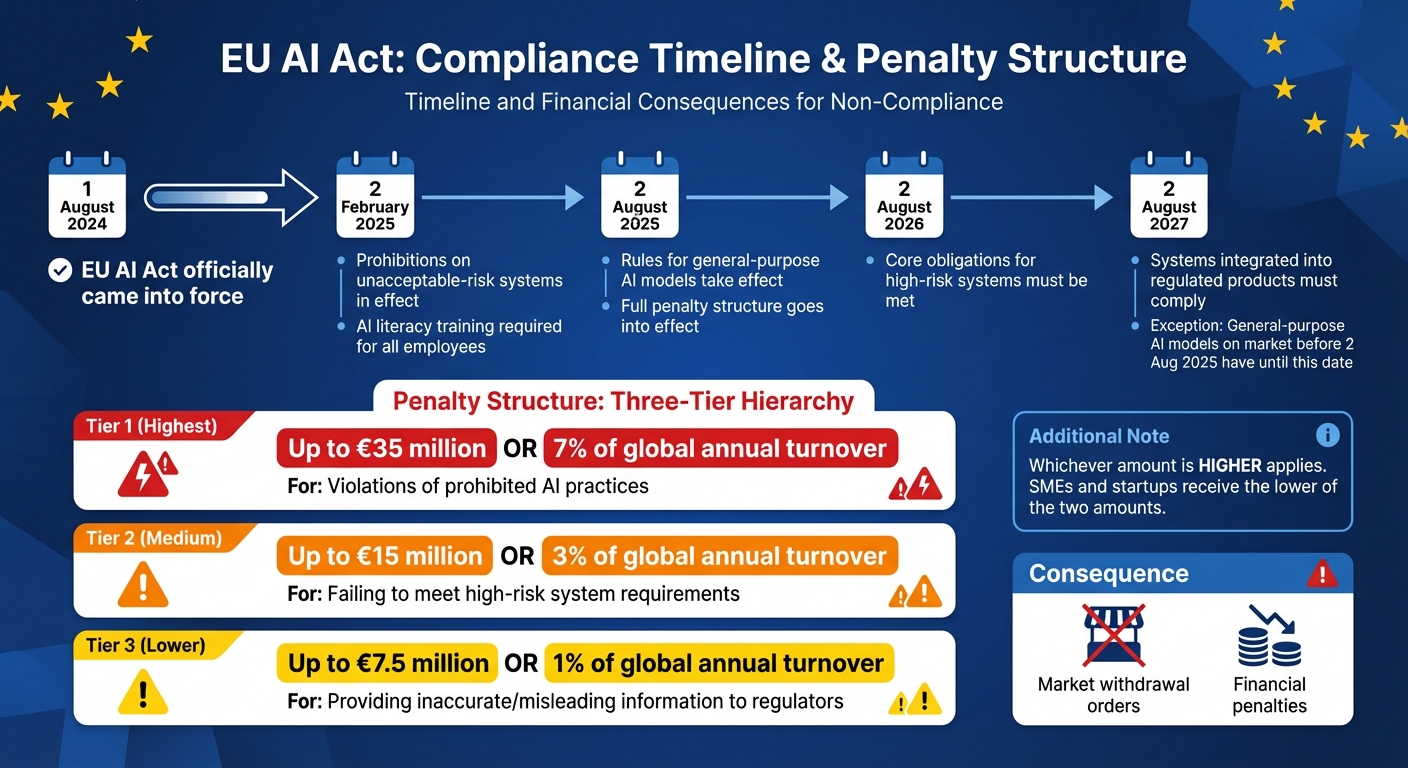

- Les risques de non-conformité incluent des amendes pouvant atteindre 35 millions d'euros ou 7 % du chiffre d'affaires annuel mondial.

- La loi classe les systèmes d'IA par risque (minimal, limité, élevé et inacceptable) et établit des obligations strictes pour les systèmes à haut risque.

- Les échéances clés débutent dès le 2 février 2025, la pleine conformité pour la plupart des systèmes à haut risque étant requise d'ici le 2 août 2026.

Pour les entreprises américaines, s'aligner sur ces règles n'est pas une option. La taille et l'influence du marché de l'UE signifient que ces normes sont en train de devenir une référence mondiale. Les mesures immédiates comprennent la mise en place d'un système de gouvernance de l'IA, la révision des contrats et l'établissement d'un suivi continu de la conformité.

Comprendre la loi européenne sur l'IA : faits clés et exigences de conformité | Série sur la littératie en IA

sbb-itb-e314c3b

Qui doit se conformer : déterminer si la loi européenne sur l'IA s'applique à votre entreprise

La loi européenne sur l'IA fait des vagues bien au-delà des frontières de l'Europe, et comprendre si elle s'applique à votre entreprise est essentiel – surtout si vous opérez aux États-Unis. Voici un examen plus approfondi de la manière dont vos activités pourraient déclencher la conformité.

Activités commerciales qui déclenchent la conformité

La portée de la loi ne se limite pas au lieu d'établissement d'une entreprise. Elle se concentre plutôt sur le fonctionnement des systèmes d'IA et leur impact. Comme le souligne KPMG :

« La loi européenne sur l'IA est applicable à de nombreuses entreprises américaines, potentiellement même celles sans présence physique dans l'UE. » [6]

Alors, qu'est-ce qui déclenche la conformité ? Si vous vendez des produits ou services d'IA dans l'UE, proposez des logiciels basés sur l'IA via des plateformes de commerce électronique, ou fournissez des modèles d'IA à usage général à des clients européens, vous êtes dans le collimateur de la loi. Même si votre système d'IA fonctionne à partir de serveurs basés aux États-Unis, il relève de la loi si ses résultats – tels que les prédictions, les recommandations ou les décisions – sont utilisés dans l'UE. Par exemple, une plateforme de recrutement américaine filtrant des CV pour un bureau allemand ou un algorithme de notation de crédit évaluant les demandes de prêt de résidents de l'UE devrait se conformer [6].

Le traitement des données personnelles des résidents de l'UE est un autre facteur déclencheur majeur. Que vous analysiez ces données pour le marketing, les évaluations des risques ou le service client, la loi s'applique. De plus, si votre technologie d'IA est intégrée dans un produit vendu par une entreprise basée dans l'UE, la conformité devient obligatoire [6].

Exigences de conformité directes et indirectes

Ce que vous devez faire pour vous conformer dépend de votre rôle dans la chaîne de valeur de l'IA. Voici comment cela se décompose :

- Fournisseurs : Si vous développez des systèmes d'IA et les mettez sur le marché de l'UE sous votre propre nom, vous êtes soumis aux règles les plus strictes. Pensez aux évaluations de conformité, aux systèmes de gestion des risques et à la documentation technique détaillée [6].

- Déployeurs : Les entreprises qui utilisent des systèmes d'IA sous leur autorité ont un ensemble de responsabilités distinct. Celles-ci incluent la surveillance des performances du système, la formation du personnel sur le fonctionnement de l'IA, et la notification aux autorités des incidents graves si l'IA est utilisée dans l'UE ou si ses résultats atteignent des utilisateurs de l'UE [3].

- Importateurs et Distributeurs : Si vous introduisez des systèmes d'IA des États-Unis dans l'UE, vous devez vérifier leur conformité, contrôler les marquages CE, et conserver des registres pour prouver que tout est en ordre [4].

Il existe également une distinction cruciale à garder à l'esprit : si vous renommez ou modifiez substantiellement un système d'IA, vous pourriez passer du statut de déployeur à celui de fournisseur. Ce changement entraîne des obligations plus strictes. Comme l'explique Vivien F. Peaden de Baker Donelson :

"Un déployeur pourrait être reclassé comme 'fournisseur' de système(s) d'IA à haut risque s'il exploite les systèmes d'IA sous son propre nom et sa propre marque, ou modifie autrement les systèmes d'IA à des fins non prévues." [3]

Pour les développeurs américains de modèles d'IA à usage général, les risques sont également importants. Si un tiers utilise votre modèle et le met à disposition dans l'UE, vous pourriez être classé comme fournisseur — à moins que vous n'ayez explicitement interdit sa distribution dans l'UE [8].

Comprendre ces rôles et ces déclencheurs est essentiel pour naviguer efficacement dans les exigences de l'Acte sur l'IA de l'UE.

Les 4 catégories de risque : Comment l'Acte sur l'IA de l'UE classe les systèmes d'IA

L'Acte sur l'IA de l'UE organise les systèmes d'IA en quatre niveaux de risque — minimal, limité, élevé et inacceptable — afin d'établir le niveau de réglementation requis pour chaque catégorie. Comme l'expliquent Mario F. Ayoub, Jessica L. Copeland et Sarah Jiva de Bond Schoeneck & King PLLC :

"L'Acte adopte une approche basée sur les risques, les obligations variant selon qu'un système d'IA est considéré comme présentant un risque minimal, limité, élevé ou inacceptable." [7]

Cette structure aide les entreprises à comprendre les mesures de conformité nécessaires pour leurs systèmes d'IA. Voici un aperçu détaillé de chaque catégorie.

Risque inacceptable : Systèmes d'IA interdits

Certaines applications d'IA sont jugées trop dangereuses pour être utilisées dans l'UE et seront interdites à partir du 2 février 2025 [7]. Cela inclut les systèmes qui manipulent le comportement par des techniques subliminales, exploitent des groupes vulnérables ou utilisent la notation sociale. D'autres utilisations interdites concernent le moissonnage non ciblé d'images faciales provenant de plateformes en ligne ou de séquences de vidéosurveillance pour créer des bases de données de reconnaissance, ainsi que les systèmes de police prédictive qui profilent les individus en fonction de caractéristiques innées. L'identification biométrique en temps réel dans les espaces publics est également prohibée, à l'exception de certaines applications strictes d'application de la loi, comme la recherche d'enfants disparus ou la prévention d'une attaque terroriste imminente [6].

Les entreprises utilisant ces technologies doivent cesser leurs activités immédiatement sous peine de lourdes sanctions – jusqu'à 35 millions d'euros ou 7 % de leur chiffre d'affaires annuel mondial [10].

Risque élevé : Exigences pour les applications d'IA critiques

Bien que la loi interdise les systèmes les plus dangereux, elle autorise l'IA à haut risque sous des réglementations strictes. Selon KPMG :

"Les systèmes d'IA à haut risque créent un risque élevé pour la santé et la sécurité ou les droits du consommateur. Ces systèmes sont autorisés sur le marché de l'UE sous réserve du respect de certaines exigences obligatoires et d'une évaluation de la conformité." [6]

Les systèmes à haut risque se répartissent en deux groupes. Le premier comprend l'IA intégrée à des produits réglementés, tels que les dispositifs médicaux, les véhicules, les jouets et les machines, qui relèvent déjà des lois européennes sur la santé et la sécurité [11]. Le second groupe couvre l'IA utilisée dans des domaines sensibles comme le recrutement, la notation de crédit, les infrastructures critiques (par exemple, les systèmes d'eau et d'énergie), les admissions à l'éducation, l'application de la loi, le contrôle aux frontières et l'administration judiciaire [9].

Les fournisseurs de systèmes à haut risque doivent satisfaire à des exigences rigoureuses avant de lancer leurs produits. Celles-ci incluent la mise en œuvre de systèmes de gestion des risques, la garantie d'une gouvernance des données pour réduire les biais, la tenue d'une documentation technique, la possibilité d'une supervision humaine et l'enregistrement automatique des décisions [12]. De plus, ces systèmes doivent être enregistrés dans une base de données européenne dédiée et faire l'objet d'évaluations de conformité. Le non-respect de ces exigences pourrait entraîner des amendes allant jusqu'à 15 millions d'euros ou 3 % du chiffre d'affaires annuel mondial. La plupart des systèmes à haut risque devront être conformes d'ici le 2 août 2026 [10].

Cependant, tous les systèmes d'IA listés à l'Annexe III ne relèvent pas des réglementations à haut risque. Si un système n'effectue que des tâches spécifiques, soutient les décisions humaines ou gère des travaux préparatoires – comme la mise en forme de CV plutôt que le filtrage ou le classement de candidats – il est exempté de ces exigences.

Risque limité et minimal : exigences allégées et exemptions

Les systèmes d'IA présentant des risques moindres ont moins d'obligations. Les systèmes à risque limité doivent respecter des exigences de transparence, comme les chatbots qui doivent divulguer leur nature non humaine ou les contenus générés par l'IA qui doivent être clairement étiquetés comme synthétiques. En revanche, les systèmes à risque minimal, qui incluent des outils comme les filtres anti-spam ou les jeux vidéo basés sur l'IA, ne sont soumis à aucune réglementation obligatoire [6].

Bien que la loi encourage des codes de conduite volontaires pour ces systèmes, la conformité reste facultative [6]. Les systèmes à risque minimal constituent la majorité des applications d'IA utilisées aujourd'hui, bénéficiant de ces exigences allégées.

Dates clés et sanctions : que se passe-t-il en cas de non-conformité

Calendrier de conformité de la loi européenne sur l'IA et structure des sanctions pour les entreprises américaines

Pour les entreprises américaines confrontées à l'effet de Bruxelles, il est essentiel de maîtriser les échéances et les sanctions de la loi européenne sur l'IA. Cette loi est officiellement entrée en vigueur le 1er août 2024 [15][17]. Le non-respect de ces délais peut entraîner de lourdes amendes et des restrictions d'accès au marché.

Les échéances de conformité à connaître

La loi européenne sur l'IA adopte un calendrier échelonné basé sur le niveau de risque des systèmes d'IA. Voici le détail des dates clés :

- 2 février 2025 : Les interdictions concernant les systèmes à « risque inacceptable », tels que la notation sociale ou la reconnaissance des émotions sur le lieu de travail, sont déjà en vigueur. Les entreprises utilisant ces technologies doivent cesser immédiatement [7][20].

- 2 août 2025 : Les règles relatives aux modèles d'IA à usage général et la structure complète des sanctions entrent en vigueur [5][7].

- 2 août 2026 : Les obligations fondamentales pour les systèmes à haut risque doivent être respectées à cette date.

- 2 août 2027 : Les systèmes intégrés dans des produits réglementés doivent être conformes à cette date [5][7].

Il existe une exception notable pour les fournisseurs d'IA à usage général. Si leurs modèles étaient déjà sur le marché avant le 2 août 2025, ils ont jusqu'au 2 août 2027 pour se conformer [16][17]. De plus, à partir du 2 février 2025, les entreprises doivent s'assurer que tous les employés impliqués dans les opérations d'IA reçoivent une formation adéquate en « littératie de l'IA » [16].

Ces délais sont stricts, sans période de grâce. Une fois le calendrier compris, il est tout aussi important de saisir les sanctions en cas de non-conformité.

Sanctions financières et restrictions de marché

La loi européenne sur l'IA impose un système de sanctions à trois niveaux. Les amendes sont calculées soit comme un montant fixe, soit comme un pourcentage du chiffre d'affaires annuel mondial – le montant le plus élevé étant retenu [18][19]. Voici comment les sanctions se répartissent :

- Jusqu'à 35 millions d'euros ou 7 % du chiffre d'affaires annuel mondial pour les violations des pratiques d'IA interdites [5][20].

- Jusqu'à 15 millions d'euros ou 3 % du chiffre d'affaires mondial pour le non-respect des exigences relatives aux systèmes à haut risque [5].

- Jusqu'à 7,5 millions d'euros ou 1 % du chiffre d'affaires mondial pour la fourniture d'informations inexactes ou trompeuses aux régulateurs [20].

Au-delà des amendes, les entreprises non conformes peuvent se voir ordonner de retirer leurs systèmes d'IA du marché de l'UE [5][20]. Pour les petites entreprises, telles que les PME et les startups, le montant le plus bas des deux pénalités (fixe ou pourcentage) est appliqué, offrant un certain allègement [18].

Ces pénalités, combinées à des délais stricts, soulignent l'importance de la conformité pour toute entreprise américaine opérant dans l'UE. Ignorer ces exigences n'est pas une option.

Comment se préparer : les étapes que les entreprises américaines devraient suivre dès maintenant

Pour les entreprises américaines, s'aligner sur l'AI Act de l'UE exige une action immédiate. Décomposer le processus en étapes claires – comme la mise en place d'un système de gouvernance, la révision des contrats et l'établissement d'une surveillance continue – peut rendre la conformité plus gérable.

Construire un système de gouvernance de l'IA

Commencez par cataloguer chaque système d'IA utilisé par votre entreprise. Cela inclut les systèmes développés en interne, ceux sous licence de fournisseurs, et même l'IA intégrée dans les produits que vous vendez. Une fois répertorié, classez chaque système dans l'une des quatre catégories de risque : Inacceptable, Élevé, Limité ou Minimal [6][4][21]. Il existe plus de 138 exemples de cas d'utilisation d'IA à haut risque dans des secteurs tels que la santé, la finance et le recrutement [2].

Ensuite, déterminez le rôle de votre entreprise en vertu de la loi. Êtes-vous un fournisseur (créateur d'IA), un déployeur (utilisateur d'IA), un importateur (introduisant l'IA dans l'UE) ou un distributeur (revendeur d'IA) ? Chaque rôle s'accompagne de responsabilités légales spécifiques [5][4][22].

Après avoir cartographié vos systèmes et rôles, désignez du personnel de supervision pour surveiller l'utilisation de l'IA, garantir l'implication humaine et traiter rapidement les écarts [5][2]. Les systèmes à haut risque nécessitent un système de gestion des risques pour identifier et minimiser les risques prévisibles [4][2]. Cela inclut de s'assurer que les ensembles de données d'entraînement, de validation et de test sont impartiaux et représentatifs [5][2]. Comme le souligne KPMG :

« Le responsable de la sécurité des systèmes d'information (RSSI) est un rôle senior clé qui sera le plus affecté par la loi européenne sur l'IA, car elle aura un impact sur la manière dont les entreprises développent et déploient les technologies d'IA et sécurisent leurs données. » [6]

Pour renforcer la gouvernance, alignez les cadres internes sur des normes telles que ISO 42001, le NIST AI Risk Management Framework ou les lignes directrices de l'OCDE [6][23]. Si vous gérez plusieurs systèmes d'IA, les outils de détection automatisés peuvent simplifier le processus d'inventaire [6].

Une fois votre système de gouvernance en place, mettez à jour les cadres juridiques et techniques pour refléter ces changements.

Révision des contrats et de la documentation technique

Mettez à jour les contrats et la documentation pour répondre aux exigences de l'EU AI Act. Auditez les contrats d'approvisionnement avec les fournisseurs pour vous assurer qu'ils fournissent la documentation technique et les instructions d'utilisation nécessaires pour les systèmes à haut risque [5][14]. Définissez clairement les rôles et les responsabilités dans les accords de service, que vous soyez un fournisseur ou un déployeur [5][2]. Pour les modèles d'IA tiers, confirmez que les données d'entraînement sont exactes et que vous détenez les droits de propriété intellectuelle et de confidentialité requis [2].

Pour les systèmes à haut risque, assurez-vous que la documentation technique inclut des journaux auditables, des descriptions de gestion des risques et des enregistrements des processus de formation et de test [5][4]. Mayer Brown conseille :

"Le coût de génération de la documentation technique est relativement faible si elle est intégrée à l'outil d'IA dès le début." [2]

Intégrez la journalisation et le suivi des métadonnées dans vos systèmes d'IA pour surveiller les performances en temps réel. Cela inclut la vérification de l'équité, de la précision, des biais et des risques de cybersécurité [2].

Mettez à jour vos accords de niveau de service (SLA) pour y inclure des clauses de surveillance post-commercialisation. Les fournisseurs devraient être tenus de signaler les incidents graves ou la dérive des modèles susceptibles d'affecter la conformité [5][4][2]. Si vous fournissez des systèmes à haut risque, vous devez fournir aux déployeurs des instructions détaillées sur les limitations du système et les exigences en matière de supervision humaine [14]. Les rapports de transparence décrivant les capacités et les limitations du système sont également essentiels [2].

Une fois les contrats et la documentation en ordre, l'étape suivante consiste à se concentrer sur le maintien de la conformité.

Maintenir la conformité grâce à des examens réguliers

Un examen continu est essentiel pour rester conforme. L'EU AI Act impose une surveillance post-commercialisation pour les systèmes à haut risque, exigeant des entreprises qu'elles collectent et analysent les données de performance tout au long de la durée de vie du système [5][4]. Un défi majeur est la dérive des modèles, où les modèles d'IA perdent en précision ou en équité au fil du temps [2]. Mayer Brown explique :

"La loi de l'UE exige des tests, une surveillance et des audits, avant et après le déploiement de l'IA à haut risque... La raison sous-jacente à cette exigence est la question de la dérive des modèles." [2]

Intégrer une surveillance en temps réel dans vos systèmes d'IA. Mettez en place des processus pour tester régulièrement la précision, les biais et la dérive des modèles [2]. Documentez tout problème de performance ou incident, car ces enregistrements sont essentiels pour démontrer la responsabilité aux régulateurs [5][4]. Les systèmes à haut risque devraient également inclure un "interrupteur d'arrêt d'urgence" pour les désactiver si la conformité ne peut être rétablie [2].

Mener des analyses d'écarts régulières pour comparer vos politiques aux exigences de la Loi et remédier à toute lacune avant l'échéance [6][23][21]. Utilisez des outils tels que l'IAPP Global AI Law and Policy Tracker ou la Matrice de conformité de l'Acte sur l'IA de l'UE pour rester informé des mises à jour réglementaires. Pour les entreprises gérant plusieurs systèmes d'IA, les solutions automatisées peuvent simplifier le suivi de la conformité et la gestion des flux de travail. Comme le souligne KPMG :

"L'exploitation d'une solution automatisée pour gérer divers aspects de la cartographie de la conformité, du suivi des obligations et de la gestion des flux de travail peut aider à soutenir et à étendre diverses activités de gouvernance." [6]

Les entreprises américaines peuvent également adhérer au « Pacte IA » de la Commission européenne, une initiative volontaire visant à adopter des obligations clés avant leur mise en œuvre. Cette démarche proactive réduit non seulement les risques de conformité, mais positionne également votre entreprise comme un leader en matière de pratiques d'IA responsables.

Conclusion : Utiliser la réglementation européenne sur l'IA comme avantage commercial

La loi européenne sur l'IA offre aux entreprises américaines avant-gardistes une opportunité de conserver leur avance. Une conformité précoce garantit un accès fluide à une base de consommateurs de 450 millions, tout en devançant les concurrents qui tardent [25][26].

Comme le dit Peter Stockburger, associé directeur de bureau chez Dentons :

"Les organisations qui s'y prennent correctement peuvent gagner des parts de marché et répondre aux besoins croissants des clients, des partenaires et des régulateurs, qui attendent de plus en plus des organisations qu'elles développent et déploient l'IA de manière responsable, sûre et éthique." [24]

Opérer selon un modèle unifié et conforme à l'UE est non seulement rentable, mais protège également les entreprises de la complexité liée à la navigation entre des normes variées. Cela les prépare également à la vague croissante de lois étatiques américaines qui reprennent les principes de l'UE. D'ici 2025, environ 1 000 projets de loi liés à l'IA devraient être en cours dans les États américains, faisant du cadre de l'UE une base fiable pour la conformité [1][13][25][26]. La stabilité financière et réglementaire ainsi obtenue l'emporte sur les risques de retard.

Le non-respect entraîne de lourdes sanctions, une perte potentielle d'accès au marché et une diminution de la confiance [10][25]. De plus, les partenaires B2B mondiaux examinent de plus en plus attentivement les fournisseurs pour s'assurer qu'ils disposent de solides mesures de gouvernance des données avant de former des partenariats [25].

En adoptant l'approche basée sur les risques de la Loi, les entreprises américaines peuvent se positionner en leaders de la gouvernance mondiale de l'IA plutôt que de devoir rattraper leur retard. Le Center for AI Policy souligne ce point :

"Si les États-Unis restent dans leur impasse politique actuelle concernant la politique d'IA, leurs entreprises seront de fait régulées par l'UE." [1]

Les premiers adoptants peuvent acquérir un avantage distinct en démontrant un engagement envers des pratiques d'IA éthiques. Cela permet non seulement de capter des parts de marché face à des concurrents plus lents, mais aussi de renforcer la confiance des clients à l'échelle mondiale. L'EU AI Act établit la référence en matière de pratiques d'IA responsables, et les entreprises qui agissent dès maintenant façonneront l'avenir de la gouvernance de l'IA au lieu de devoir s'adapter à la hâte plus tard. En adoptant cette démarche proactive, les entreprises américaines assurent leur place sur le marché mondial tout en menant la charge dans le développement responsable de l'IA.

FAQ

Sommes-nous soumis à l'EU AI Act même sans bureau dans l'UE ?

Oui, les entreprises américaines pourraient être soumises à la loi européenne sur l'IA même si elles n'ont pas de bureau dans l'UE. La réglementation s'applique aux systèmes d'IA qui affectent des individus ou des marchés au sein de l'UE, grâce à sa portée extraterritoriale. En d'autres termes, si une entreprise cible ou opère dans l'UE, la conformité est requise, qu'elle y ait ou non une présence physique.

Comment savoir si notre IA est « à haut risque » ou exemptée ?

Pour déterminer si votre système d'IA relève de la catégorie à haut risque dans la loi européenne sur l'IA, vous devrez examiner son objectif prévu, le secteur dans lequel il opère et son impact potentiel. Ce sont les principaux facteurs énoncés dans les lignes directrices de la loi pour l'identification des systèmes à haut risque. Pour une compréhension plus approfondie, consultez les ressources qui détaillent ces classifications et ce qu'elles impliquent pour le respect des exigences de conformité.

Que devrions-nous faire en premier pour être prêts avant le 02/02/2025 ?

En prévision de l'entrée en vigueur de l'Acte sur l'IA de l'UE le 2 février 2025, commencez par vous familiariser avec sa portée et ses exigences. La première étape consiste à déterminer si vos systèmes d'IA sont couverts par la réglementation, en particulier s'ils ont un impact sur le marché de l'UE.

Ensuite, identifiez votre position dans la chaîne de valeur de l'IA : êtes-vous un fournisseur, un utilisateur ou un importateur ? Chaque rôle s'accompagne de responsabilités spécifiques, il est donc crucial de comprendre où vous vous situez.

Une fois cela clair, concentrez-vous sur l'élaboration de stratégies de conformité. Cela inclut la mise en œuvre de processus de gestion des risques rigoureux, le maintien d'une documentation détaillée et la garantie que vos systèmes répondent aux normes requises. Si vous avez des doutes sur un aspect quelconque, il est judicieux de consulter des experts pour naviguer efficacement dans les complexités de la réglementation.