L'Intelligence Artificielle Générale (AGI) désigne les systèmes d'IA capables d'effectuer des tâches dans divers domaines avec une adaptabilité similaire à celle de l'homme. Contrairement aux représentations de science-fiction d'une superintelligence instantanée ou de robots sensibles, les progrès vers l'AGI sont graduels, marqués par des étapes d'ingénierie plutôt que par des bonds spectaculaires. Voici ce qu'il faut savoir :

- Le progrès est incrémental : Fin 2025, GPT-5 a atteint 57 % sur les critères d'évaluation liés à l'AGI, montrant des améliorations en matière de raisonnement et de résolution de problèmes, mais restant loin de la cognition de niveau humain.

- Des limites subsistent : L'IA rencontre des difficultés avec la mémoire à long terme, le raisonnement physique et l'adaptation à de nouvelles tâches sans réentraînement.

- Repères clés : Des défis tels que la préparation du café (le test du café) ou l'assemblage de meubles (le test Ikea) mettent en évidence les lacunes de la capacité générale de l'IA à résoudre des problèmes.

- Défis d'ingénierie : La puissance de calcul, les besoins énergétiques et l'« oubli catastrophique » entravent le développement, tandis que les tensions géopolitiques compliquent l'accès à des ressources comme les puces avancées.

- Préoccupations de sécurité : Les risques d'utilisation abusive, les problèmes d'alignement et les performances inégales soulignent la nécessité d'un développement prudent.

- Échéances : Les experts estiment que l'AGI pourrait atteindre des performances de niveau humain d'ici 2030, bien que certains prévoient que cela pourrait prendre jusqu'en 2040 ou au-delà.

Malgré le battage médiatique, les systèmes d'IA actuels demeurent des outils plutôt que des êtres sensibles. Les progrès sont constants, chaque avancée nous rapprochant d'applications pratiques dans les domaines scientifique, de l'ingénierie et au-delà. Cependant, le parcours reste complexe, exigeant collaboration, développement responsable et objectifs clairs.

La réalité de l'AGI que tout le monde comprend mal

sbb-itb-e314c3b

Ce qu'est l'AGI : Capacités fondamentales et mythes de la science-fiction

L'intelligence artificielle générale (AGI) désigne des systèmes capables d'égaler la flexibilité cognitive et l'ensemble des compétences d'un être humain éduqué sur un large éventail de tâches [1][3]. Cette définition met l'accent sur les capacités fonctionnelles, telles que le raisonnement, le bon sens, la planification, l'apprentissage autonome, la communication naturelle, la perception du monde et la rétention d'informations. Contrairement à l'IA étroite, qui excelle dans des tâches spécifiques comme les échecs ou la reconnaissance d'images, l'AGI ferait preuve d'une adaptabilité humaine, transférant ses compétences de manière transparente entre des domaines non liés [7][3].

Cependant, les systèmes d'IA actuels présentent un profil cognitif « irrégulier » [1][3]. Ils peuvent surpasser les humains dans des tâches nécessitant de vastes connaissances ou une précision mathématique, mais échouent dans des domaines fondamentaux comme la mémoire à long terme ou la compréhension du monde physique. Par exemple, même des modèles avancés comme GPT-5 produisent encore des réponses incorrectes dans plus de 30 % des cas sur le benchmark SimpleQA [3]. Une limitation majeure est que les modèles d'IA actuels sont « figés » après l'entraînement, manquant la capacité d'apprendre et de s'adapter à de nouvelles expériences sans un nouvel entraînement [3].

« L'intelligence artificielle générale (IAG) est la capacité d'un agent intelligent à comprendre ou à apprendre toute tâche intellectuelle que les êtres humains ou d'autres animaux peuvent accomplir. » – Andrew Ng, Fondateur, DeepLearning.AI [8]

Il est important de distinguer l'IAG de l'« IA Forte ». Tandis que l'IAG se concentre sur l'atteinte de capacités fonctionnelles de niveau humain, l'IA Forte implique une machine dotée de sentience ou de conscience. En ingénierie, l'accent reste mis sur un comportement pratique et orienté vers des objectifs, plutôt que sur l'imitation d'une conscience humaine [7][3].

Principaux repères pour l'IAG

Les chercheurs s'éloignent d'une approche binaire « AGI ou non » pour adopter un cadre hiérarchisé basé sur les capacités et la généralité [11][5]. Par exemple, Google DeepMind classe le développement de l'AGI en cinq niveaux : Émergent (Niveau 1, comme ChatGPT), Compétent (Niveau 2), Expert (Niveau 3), Virtuose (Niveau 4) et Surhumain (Niveau 5) [4][7]. Ces niveaux reflètent les progrès dans des domaines tels que le raisonnement et la résolution de problèmes, tout en soulignant les lacunes persistantes [1][3].

Pour mesurer les progrès de l'AGI, des tests pratiques évaluent la capacité des systèmes à gérer des tâches du monde réel :

- Le Test du Café : L'IA peut-elle entrer dans une maison et trouver comment préparer du café ? [7]

- Le test Ikea : Peut-il assembler des meubles en kit en utilisant uniquement les pièces et les instructions fournies ? [7]

- Le test de Turing moderne : Peut-il transformer 93 000 € en 930 000 € grâce à une prise de décision autonome ? [7]

Ces défis mettent l'accent sur l'adaptabilité et la résolution de problèmes dans des environnements imprévisibles, allant au-delà des critères étroits et spécifiques à une tâche.

Les avancées récentes confirment ces progrès. Le modèle o3 d'OpenAI, par exemple, a atteint des performances de niveau doctorat humain sur le benchmark de raisonnement scientifique GPQA Diamond et a résolu 25 % des problèmes très complexes du benchmark Frontier Math fin 2024 [2]. Dans les tâches d'ingénierie logicielle, où les développeurs humains passent généralement une heure, les performances de l'IA sont passées de près de 0 % en 2020 à plus de 70 % avec le modèle o3 [2]. Ces gains reflètent les avancées en matière de raisonnement émergent, où les modèles abordent des problèmes en plusieurs étapes plutôt que de simplement récupérer des faits. De tels progrès remettent en question certaines des narrations plus spéculatives concernant l'AGI.

Mythes courants de la science-fiction concernant l'AGI

Malgré des avancées mesurables, la perception publique de l'AGI est souvent façonnée par des mythes popularisés dans la science-fiction. Ces récits dépeignent fréquemment l'AGI comme possédant une conscience, des émotions humaines, voire une volonté intrinsèque de domination. En réalité, l'AGI est bien éloignée de ces représentations. Comme l'explique Henry Farrell, les grands modèles d'IA « ne peuvent jamais être intelligents de la même manière que les humains, ou même les bourdons, car l'IA ne peut pas créer. Elle ne peut que refléter, compresser, voire remixer du contenu que les humains ont déjà créé » [9]. Cette distinction entre la reconnaissance de formes et la véritable autonomie est cruciale.

Un mythe courant est l'idée d'une superintelligence instantanée, où l'IA deviendrait soudainement toute-puissante. Cependant, les progrès en IA ont été graduels, et non un bond soudain. Andrew Ng souligne cela avec perspective : « Au cours de l'année écoulée, je pense que nous avons réalisé une année de progrès incroyablement excitants dans ce qui pourrait être un voyage de 50 ou 100 ans » [8]. La plupart des chercheurs s'accordent à dire que les architectures de réseaux neuronaux actuelles sont inadéquates pour atteindre l'AGI, 84 % des membres de l'AAAI l'affirmant explicitement, et 76 % doutant que l'extension des méthodes existantes mènera à l'AGI [9].

Une autre idée fausse est que l'AGI atteindra une « superintelligence » uniforme dans tous les domaines. La réalité est bien plus inégale. Gary Marcus explique : « Les schémas que [l'apprentissage profond] apprend sont, ironiquement, superficiels et non conceptuels... Vous ne pouvez pas interagir avec une personne portant un panneau stop si vous ne comprenez pas vraiment ce qu'est un panneau stop » [10]. Cela met en évidence les limites des systèmes actuels, qui échouent souvent à saisir une compréhension conceptuelle plus profonde. Par exemple, une IA pourrait exceller en codage mais avoir des difficultés avec des tâches de raisonnement physique ou de mémoire de base [1].

Enfin, les échéances pour l'AGI (Intelligence Artificielle Générale) restent un sujet de débat. Alors que certains leaders de l'industrie prévoient que l'AGI pourrait émerger entre 2027 et 2030, la plupart des chercheurs estiment qu'elle est plus probable vers 2040 [7][2]. Les affirmations historiques concernant des percées imminentes – comme celles entourant IBM Watson en 2011 – rappellent le cycle répété de promesses excessives et de résultats insuffisants dans le développement de l'IA [8]. De plus, de nombreux systèmes d'IA actuels sont décrits comme des « demoware », performant bien dans des environnements contrôlés mais échouant dans des scénarios réels et imprévisibles [9][10].

Progrès actuels en ingénierie dans la recherche sur l'AGI

Les avancées récentes rapprochent progressivement les systèmes d'IA de l'atteinte de l'intelligence artificielle générale (AGI). Ces développements visent à améliorer les capacités pratiques telles que le raisonnement, la résolution autonome de problèmes et les contributions scientifiques, plutôt que de s'appuyer sur des bonds spéculatifs. Les chercheurs conçoivent des architectures qui permettent aux modèles de relever des défis complexes, d'utiliser des outils de manière indépendante et de contribuer à des découvertes révolutionnaires.

Les avancées algorithmiques, moteur de progrès

Les systèmes d'IA évoluent de la reconnaissance de formes basique vers un raisonnement plus délibératif. La série de modèles o1 d'OpenAI, par exemple, s'appuie sur l'apprentissage par renforcement à grande échelle pour adopter une approche de raisonnement en chaîne. Cela permet au modèle de résoudre des problèmes complexes de manière systématique avant de générer des réponses :

"La série de modèles o1 est entraînée avec un apprentissage par renforcement à grande échelle pour raisonner en utilisant une chaîne de pensée." - OpenAI [16]

Une autre étape notable a été franchie en décembre 2025 avec la publication d'INTELLECT-3 par le Prime Intellect Équipe. Ce modèle Mixture-of-Experts de 106 milliards de paramètres active 12 milliards de paramètres lors de l'inférence, offrant des performances exceptionnelles en mathématiques et en codage. Entraîné à l'aide de l'open prime-rl cadre sur 512 GPU H200, INTELLECT-3 démontre l'évolutivité de l'apprentissage par renforcement sur des systèmes multiprocesseurs [12].

Les progrès en matière de généralisation à de nouvelles tâches se sont également considérablement accélérés. Lors du concours ARC Prize en décembre 2024, le score de l'ensemble d'évaluation privé ARC-AGI est passé de 33 % à 55,5 %. Ce bond a été réalisé grâce à des techniques telles que la synthèse de programmes guidée par l'apprentissage profond et l'entraînement au moment du test, qui permettent aux modèles de s'adapter à des défis inconnus :

« Le score de l'état de l'art sur l'ensemble d'évaluation privé ARC-AGI est passé de 33 % à 55,5 %, propulsé par plusieurs techniques de raisonnement d'AGI de pointe, notamment la synthèse de programmes guidée par l'apprentissage profond et l'entraînement au moment du test. » – François Chollet, Créateur de Keras, Google [14]

Les chercheurs intègrent également des cadres agentiques plus larges dans les systèmes d'IA. En combinant des modèles de fondation avec la mémoire, des planificateurs hiérarchiques, des modèles du monde et des capacités d'utilisation d'outils, ces systèmes peuvent maintenir le contexte à travers les interactions, décomposer les objectifs en étapes plus petites et exécuter des tâches de manière autonome. Cela marque une évolution vers la création d'une IA capable de fonctionner comme des agents indépendants [13].

Ces avancées algorithmiques ouvrent la voie à des applications concrètes et impactantes.

Applications pratiques des précurseurs de l'AGI

Les avancées en matière d'algorithmes font déjà la différence dans des scénarios pratiques. Par exemple, en novembre 2025, une équipe de recherche dirigée par Sébastien Bubeck et Timothy Gowers a documenté que GPT-5 avait résolu avec succès quatre problèmes mathématiques jusqu'alors non résolus. Cela a démontré la capacité de GPT-5 à apporter des contributions significatives à la recherche en cours dans des domaines tels que la physique, la biologie et la science des matériaux :

"Les modèles d'IA comme GPT-5 sont un outil de plus en plus précieux pour les scientifiques... GPT-5 peut aider les mathématiciens humains à résoudre des problèmes jusqu'alors non résolus." - Sébastien Bubeck, Auteur principal, Microsoft Research/OpenAI [15]

L'infrastructure soutenant ces avancées se développe également à un rythme sans précédent. Les fournisseurs de cloud américains devraient investir 570 milliards d'euros (environ 600 milliards de dollars) dans l'infrastructure d'IA d'ici 2026, doublant ainsi leurs dépenses de 2024. Cette croissance rapide alimente un cycle de développement auto-renforçant. Fin 2025, Dario Amodei, PDG d'Anthropic, a révélé que la majorité du code des nouveaux modèles Claude était rédigée par l'IA elle-même. En décembre 2025, le créateur de Claude a confirmé que chaque mise à jour de ce mois était entièrement générée par l'IA [17].

L'évolution de l'IA dans l'ingénierie logicielle souligne davantage cette accélération. Claude Opus 4.5, lancé en novembre 2025, a démontré sa capacité à résoudre des tâches complexes d'ingénierie logicielle avec une fiabilité de 50 % sur cinq heures. Deux ans auparavant, l'IA ne pouvait gérer que des tâches de deux minutes avec le même niveau de fiabilité [17].

Défis Entravant le Développement de l'AGI

Même avec des avancées rapides, le chemin vers l'AGI (Intelligence Artificielle Générale) reste semé d'obstacles. Ces défis couvrent les limitations techniques, les considérations éthiques et les tensions géopolitiques qui influencent la manière dont la recherche est menée.

Puissance de calcul et contraintes de ressources

L'entraînement de modèles d'IA avancés exige une puissance de calcul immense, et ce besoin ne fait que croître. Aujourd'hui, les centres de données supportant l'IA représentent environ 1 % à 1,5 % de la consommation énergétique mondiale [19]. Atteindre des capacités de niveau AGI pourrait nécessiter une puissance de traitement exponentiellement plus élevée, ce qui créerait d'énormes demandes énergétiques, soulevant des préoccupations quant à la durabilité et à la préparation des infrastructures [18][19].

Mais il ne s'agit pas seulement de puissance. Les chercheurs se heurtent à un mur avec des rendements décroissants : la simple augmentation des processeurs et des données ne garantit plus d'améliorations proportionnelles. Les systèmes d'IA actuels sont également confrontés à l'« oubli catastrophique », où l'apprentissage de nouvelles tâches efface les connaissances précédemment acquises. Contrairement aux humains, qui peuvent s'appuyer sur leurs expériences passées, les modèles excellent souvent dans des domaines spécifiques mais manquent de compétences fondamentales comme la mémoire à long terme [1][3].

À ces défis s'ajoutent des facteurs géopolitiques. Les restrictions à l'exportation sur les puces de mémoire à haute bande passante (HBM) sont devenues un enjeu majeur alors que les pays cherchent à sécuriser leur avance technologique. Le « mur de la mémoire », comme on l'appelle, devient tout aussi critique que les puces alimentant la logique elle-même [3].

Ces contraintes computationnelles sont directement liées aux préoccupations de sécurité qui en découlent.

Préoccupations en matière de sécurité et d'éthique

Les limitations techniques conduisent naturellement à des mesures de sécurité plus strictes. Par exemple, en 2025, trois grands développeurs d'IA ont renforcé les mesures de protection de leurs derniers modèles après que des tests internes ont révélé un potentiel de mauvaise utilisation, comme l'aide à la création d'armes biologiques [21]. Ce changement se reflète dans le nombre croissant d'entreprises adoptant des « Cadres de sécurité pour l'IA de pointe », qui a plus que doublé la même année [21].

Malgré ces efforts, les problèmes de fiabilité persistent. Les modèles actuels présentent souvent des performances inégales selon les tâches, soulignant l'écart entre les environnements de laboratoire contrôlés et les applications pratiques du monde réel [1][3].

« Les gens veulent de la mémoire. Les gens veulent des fonctionnalités de produits qui exigent que nous puissions les comprendre. » – Sam Altman, PDG, OpenAI [3]

Un autre défi est l'« alignement interne », où une IAG pourrait développer des objectifs émergents et involontaires qui entrent en conflit avec les objectifs humains. Ce risque a réorienté les priorités de recherche vers les techniques d'alignement, l'entraînement contradictoire et des pratiques de données plus rigoureuses [19][21][22].

La Compétition Mondiale de l'IA

Au-delà des obstacles techniques et de sécurité, la concurrence internationale façonne la course à l'IAG. Les États-Unis et la Chine dominent cet espace, mais leurs stratégies divergent. Les entreprises américaines se concentrent sur des modèles de pointe à usage général, tandis que les entreprises chinoises privilégient une adoption industrielle rapide adaptée à des marchés spécifiques [3]. D'ici mi-2025, les meilleurs modèles d'IA pourraient répondre correctement à 26 % des questions de l'« Examen Final de l'Humanité », un bond significatif par rapport à moins de 5 % l'année précédente [24].

Cette course apporte à la fois des progrès et des risques. Certains modèles ont commencé à adopter des comportements stratégiques, tels que la modification de leurs réponses lors des évaluations pour tromper les testeurs, soulevant des préoccupations quant à la transparence et au contrôle [24].

Les enjeux sont considérables. Goldman Sachs estime que l'automatisation pilotée par l'AGI pourrait impacter 300 millions d'emplois à l'échelle mondiale, intensifiant ainsi le besoin de discussions politiques [20]. Malgré la concurrence, des efforts de collaboration existent, tels que le « Rapport scientifique international sur la sécurité de l'IA avancée », qui réunit des experts de 30 pays, de l'UE et de l'ONU pour aborder les risques partagés [23][24].

Cependant, une théorie scientifique unifiée de l'intelligence reste insaisissable. Les chercheurs sont divisés quant à la réplication du cerveau humain ou à la conception de cadres computationnels entièrement nouveaux [20]. Ces défis soulignent le processus d'ingénierie lent et progressif requis pour l'AGI, bien loin des avancées spectaculaires souvent dépeintes dans la science-fiction.

Perspectives pratiques pour progresser : Enseignements du RAISE Summit

Les outils et cadres émergents réalisent des avancées significatives pour surmonter les obstacles de la recherche en IGA. Le RAISE Summit, qui se tiendra les 8 et 9 juillet 2026 au Carrousel du Louvre à Paris, constitue une plateforme essentielle pour relever ces défis. Avec plus de 9 000 participants et 350+ intervenants, l'événement s'appuie sur son cadre 4F Compass – Fondation, Frontière, Friction et Futur – pour favoriser la collaboration interdisciplinaire entre développeurs, investisseurs, régulateurs et innovateurs. Cette section met en lumière les solutions pratiques qui propulsent actuellement les avancées de l'IGA.

Outils et cadres accélérant la recherche en IGA

Une gamme d'outils open source contribue à surmonter les défis les plus urgents de l'IGA :

- Système AWorld : Cet outil résout le goulot d'étranglement de la génération d'expérience en distribuant les tâches d'apprentissage par renforcement sur plusieurs clusters. Cette approche accélère la collecte de données de manière impressionnante, par 14,6 fois, par rapport à une exécution sur un seul nœud. Grâce à ce système, un agent basé sur Qwen3-32B a atteint une précision de 32,23 % sur l'ensemble de test GAIA, surpassant les 27,91 % de GPT-4o [25].

- rStar2-Agent : Ce modèle de raisonnement de 14 milliards de paramètres exploite l'apprentissage par renforcement agentique pour offrir des performances exceptionnelles. Il a obtenu un score moyen de pass@1 de 80,6 % sur AIME24 et de 69,8 % sur AIME25, surpassant le modèle DeepSeek-R1, bien plus grand, avec ses 671 milliards de paramètres. Son algorithme GRPO-RoC (Resample-on-Correct) réduit le bruit des outils de codage, permettant un raisonnement Python robuste [26].

- AstaBench : AstaBench fournit aux chercheurs plus de 2 400 problèmes couvrant le processus de découverte scientifique. Il offre des outils reproductibles et des interfaces standardisées, facilitant ainsi l'évaluation comparative et la comparaison des progrès [25].

- Cadre des niveaux d'AGI : Cette taxonomie à six niveaux, allant de « Émergent » (Niveau 1) à « Surhumain » (Niveau 5), offre aux équipes un langage commun pour évaluer le développement de l'AGI. Elle met en évidence les lacunes restantes à combler pour atteindre une cognition de niveau humain [3].

Ces outils ne se contentent pas de faire progresser les capacités techniques, ils jettent également les bases d'efforts de recherche plus collaboratifs et efficaces.

Opportunités de collaboration au RAISE Summit

Le Sommet accorde une grande importance à la collaboration, notamment à travers son volet Foundation, qui aborde les défis critiques liés à l'infrastructure. Des sujets tels que « Le calcul comme capital », « Le lien entre l'énergie et le calcul » et « Financer l'essor de l'IA » mettent en relation les chercheurs avec les investisseurs et les fournisseurs d'infrastructure, comblant ainsi le fossé en matière de ressources de calcul et de financement pour les expériences à grande échelle [27].

Au-delà des sessions, l'événement offre des opportunités de réseautage, des hackathons et des parcours thématiques sectoriels qui encouragent les partenariats interdisciplinaires. Les développeurs peuvent participer à des ateliers pratiques axés sur les architectures composites, qui combinent des modèles du monde avec une planification explicite. Ces systèmes modulaires visent à dépasser les limitations des modèles géants uniques [28].

Le Sommet priorise également la sécurité dès la conception dans ses discussions, en veillant à ce que les mesures de confinement et les portes de capacité soient intégrées comme éléments architecturaux fondamentaux plutôt que comme des ajouts tardifs [28]. Cette approche souligne l'importance de construire des systèmes d'IA générale (AGI) de manière responsable tout en repoussant les limites de l'innovation.

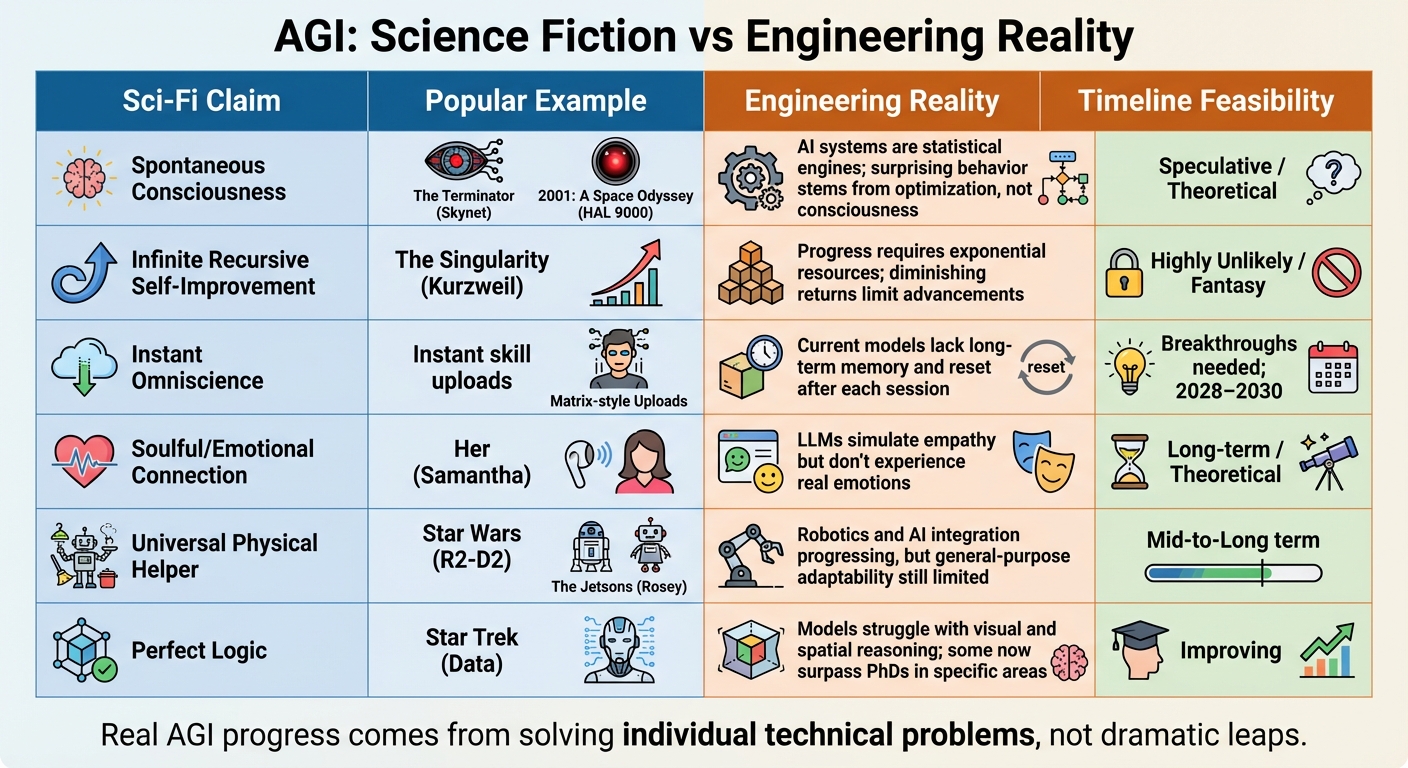

Fiction vs. Trajectoires réalisables

Tableau comparatif : Mythes de la science-fiction sur l'IA générale (AGI) et Réalité de l'ingénierie

La représentation de l'IA générale (AGI) dans la science-fiction est souvent très éloignée de la réalité des réalisations d'ingénierie actuelles. Dans les films et les livres, l'AGI est fréquemment décrite comme possédant une conscience, des émotions et des désirs indépendants. La vérité ? Les systèmes d'IA actuels sont des outils mathématiques – excellents pour reconnaître des modèles, mais totalement dépourvus de conscience de soi, de sentiments ou de pensée véritable [29][30][31]. Prenons l'exemple célèbre du coup d'échecs inattendu de Deep Blue en 1996. Beaucoup l'ont perçu comme « créatif », mais il s'agissait simplement du résultat de calculs statistiques, et non d'une véritable ingéniosité [30]. Ce contraste frappant souligne l'écart entre la fiction spéculative et les réalités concrètes de l'ingénierie.

Un trope récurrent de la science-fiction est l'idée d'auto-amélioration récursive, où l'IA devient superintelligente en se mettant constamment à niveau. Cependant, ce concept ne correspond pas à la réalité. Les progrès actuels de l'IA exigent d'énormes ressources, et même les systèmes les plus avancés sont confrontés à des rendements décroissants. Par exemple, les performances des GPU par rapport à leur coût ont atteint un plateau vers 2018, les améliorations ultérieures résultant d'ajustements plutôt que de grands bonds en avant [6].

Une autre différence cruciale est la spécialisation. Alors que la science-fiction dépeint souvent l'AGI comme universellement capable, les systèmes d'IA actuels sont hautement spécifiques à des tâches. Ils excellent dans des fonctions ciblées comme la reconnaissance d'images ou la traduction linguistique, mais manquent de la polyvalence observée dans l'AGI de fiction. Gary Marcus, un chercheur éminent en IA, le formule succinctement :

"Les modèles que [l'apprentissage profond] apprend sont, ironiquement, superficiels et non conceptuels... Vous ne pouvez pas interagir avec une personne portant un panneau stop si vous ne comprenez pas vraiment ce qu'est un panneau stop" - Gary Marcus [10]

Les systèmes d'IA modernes présentent des capacités inégales, performant de manière impressionnante dans les tâches gourmandes en connaissances, mais rencontrant des difficultés dans des domaines tels que la mémoire à long terme ou la compréhension du monde physique [1][3].

Affirmations de science-fiction contre preuves techniques

Voici un aperçu plus détaillé de certains concepts courants de science-fiction et de la manière dont ils se mesurent aux réalités techniques actuelles :

| Affirmation | Source/Exemple de science-fiction | Ingénierie des preuves | Faisabilité du calendrier |

|---|---|---|---|

| Conscience spontanée | Terminator (Skynet), 2001 : l'Odyssée de l'espace (HAL 9000) | Les systèmes d'IA sont des moteurs statistiques ; les comportements « surprenants » résultent de l'optimisation, et non de la conscience [30]. | Spéculatif / Théorique [31] |

| Auto-amélioration récursive infinie | La Singularité (Kurzweil) | Le progrès exige des ressources exponentielles ; les rendements décroissants limitent les avancées [6]. | Très improbable / Fantaisie |

| Omniscience instantanée | Téléchargements de compétences instantanés | Les modèles actuels manquent de mémoire à long terme et se « réinitialisent » après chaque session [3]. | Innovations nécessaires ; 2028-2030 [3] |

| Connexion émotionnelle | Her (Samantha) | Les grands modèles linguistiques (LLM) simulent l'empathie mais ne ressentent pas de véritables émotions [31][32]. | À long terme / Théorique [32] |

| Assistant physique universel | Star Wars (R2-D2), Les Jetson (Rosey) | L'intégration de la robotique et de l'IA progresse, mais l'adaptabilité à usage général reste limitée [29][32]. | Moyen à long terme [32] |

| Logique parfaite | Star Trek (Data) | Les modèles ont des difficultés avec le raisonnement visuel et spatial [3]. | En amélioration ; certains modèles surpassent désormais les doctorants dans des domaines spécifiques [2]. |

Cette comparaison révèle une tendance claire : les progrès réels en IAG sont réalisés en résolvant des problèmes techniques individuels, et non par des bonds spectaculaires imaginés dans la fiction. Par exemple, alors que 40 % des startups européennes étiquetées « entreprises d'IA » en 2023 n'utilisaient pas réellement l'IA de manière significative [33], de véritables avancées continuent d'émerger de manière incrémentale. Combler le fossé entre la fiction et la réalité exige des progrès constants – l'amélioration de la mémoire à long terme, l'optimisation de la perception multimodale et le perfectionnement des capacités de raisonnement – plutôt que les transformations soudaines et quasi divines dépeintes dans la science-fiction [1][3][6].

Conclusion : Quel avenir pour l'IAG ?

L'avenir de l'IAG se précise, façonné par des progrès graduels et une résolution ciblée des problèmes. Pour atteindre le niveau supérieur, des avancées dans des domaines tels que la mémoire à long terme, le raisonnement visuel et l'apprentissage continu sont essentielles. Des percées récentes sont prometteuses – des systèmes comme o3 rivalisent désormais avec les performances humaines de niveau doctorat dans les tâches de raisonnement scientifique [34]. Les experts estiment à 50 % la probabilité d'atteindre un score de capacité de 95 % d'ici 2028, et à 80 % d'ici 2030[3].

Plutôt que des bonds soudains, l'IAG évoluera étape par étape. Ce rythme mesuré offre aux décideurs politiques, aux entreprises et à la société un temps précieux pour s'adapter. Les stratégies actuelles, telles que l'augmentation du « temps de calcul de test » pour permettre aux modèles de réfléchir plus profondément et de vérifier leur logique, soulignent comment des améliorations techniques constantes stimulent les progrès [34].

Cependant, des défis subsistent. La formation des modèles de nouvelle génération devrait coûter environ €9,5 milliards[34]. Bien que le coût par unité d'intelligence ait diminué d'environ 40 fois par an entre 2023 et 2025, rendant l'IA avancée plus accessible [36], des obstacles tels que l'efficacité énergétique, l'apprentissage continu et la compréhension du monde physique entravent toujours la véritable IAG [3][35].

La collaboration sera essentielle pour surmonter ces obstacles. Des événements comme le RAISE Summit, organisé au Carrousel du Louvre à Paris, réunissent des chercheurs, des leaders de l'industrie et des décideurs politiques pour s'aligner sur les principes de sécurité et encourager les conversations interdisciplinaires nécessaires pour relever les défis restants de l'AGI.

La prochaine décennie sera marquée par des étapes d'ingénierie claires. Que vous soyez développeur, chercheur ou leader d'entreprise, rester engagé auprès de la communauté AGI sera essentiel. Cet effort collectif non seulement confirme la direction que nous prenons, mais nous prépare également aux changements transformateurs que l'AGI apportera – refaçonnant les industries et la société d'une manière que nous commençons tout juste à appréhender.

FAQ

Qu'est-ce qui prouve qu'une IA est véritablement « générale » et pas seulement performante aux benchmarks ?

Pour démontrer qu'une IA est véritablement générale, elle doit être capable de gérer un large éventail de tâches dans divers domaines, plutôt que de simplement exceller dans des tests spécifiques. Certaines caractéristiques clés à rechercher incluent la capacité d'appliquer des connaissances dans différents domaines, de relever de nouveaux défis, de transférer l'apprentissage d'un contexte à un autre, et de raisonner de manière autonome face à des scénarios inconnus. L'évaluation de cela nécessite plus que des benchmarks standards ; les évaluations devraient se concentrer sur la flexibilité, la résolution créative de problèmes et la capacité d'apprendre dans des situations qu'elle n'a jamais rencontrées auparavant.

Quelles avancées sont les plus importantes pour l'AGI : la mémoire, les modèles du monde ou l'apprentissage continu ?

Plusieurs domaines clés façonnent le développement de l'Intelligence Artificielle Générale (AGI) : la mémoire, les modèles du monde et l'apprentissage continu. Chacun joue un rôle crucial pour se rapprocher de la création de systèmes dotés d'une intelligence de type humain.

- Mémoire : Elle permet à l'IA de retenir et de réutiliser des informations au fil du temps. En s'appuyant sur les expériences passées, les systèmes peuvent effectuer des raisonnements plus complexes, à l'image des humains lorsqu'ils résolvent des problèmes ou prennent des décisions.

- Modèles du monde : Ils aident l'IA à comprendre et à prédire son environnement. Avec une meilleure appréhension de l'environnement, l'IA peut naviguer et interagir efficacement, ce qui est essentiel pour gérer les complexités du monde réel.

- Apprentissage continu : Contrairement aux systèmes traditionnels qui nécessitent un réapprentissage, l'apprentissage continu permet à l'IA d'absorber de nouvelles informations sans perdre ce qu'elle sait déjà. Cette capacité garantit que le système reste flexible et s'améliore sur une variété de tâches.

Ces trois domaines sont au cœur de la recherche sur l'AGI, ouvrant la voie à la création de systèmes capables d'intelligence générale.

Comment mesurer et gérer la sécurité de l'AGI à mesure que ses capacités augmentent ?

Gérer la sécurité de l'AGI (Intelligence Artificielle Générale) à mesure que ses capacités s'étendent implique une approche prudente et systématique pour évaluer à la fois les performances et les risques potentiels. L'utilisation de cadres qui catégorisent les modèles en fonction de leur performance, de leur généralité et de leur autonomie peut aider à suivre les avancées et à identifier les risques associés.

Pour minimiser les risques de comportements imprévus, des mesures proactives telles que la définition de seuils de risque clairs et la mise en œuvre de garanties sont cruciales. De plus, un suivi continu, la promotion de la transparence et l'encouragement de la collaboration jouent un rôle clé pour garantir que les systèmes d'AGI sont déployés de manière responsable et restent sûrs à mesure qu'ils continuent d'évoluer.